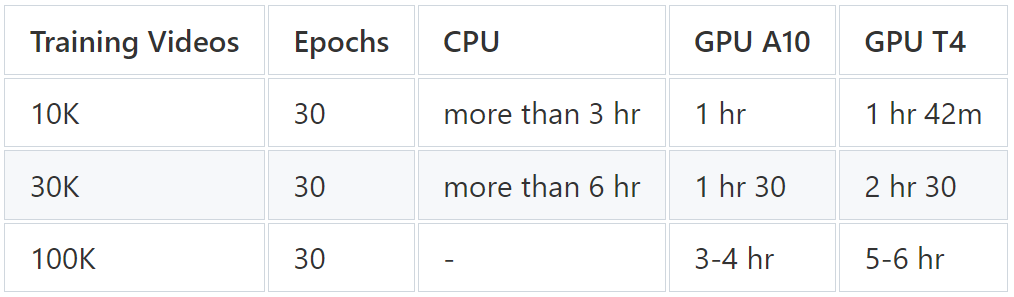

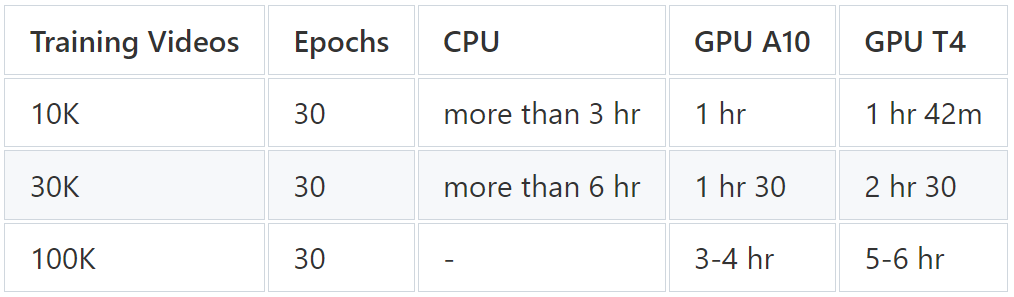

从零开始,用英伟达T4、A10训练小型文生视频模型,几小时搞定

从零开始,用英伟达T4、A10训练小型文生视频模型,几小时搞定很翔实的一篇教程。

很翔实的一篇教程。

随着 AI for Science 受到越来越多的关注,人们更加关心 AI 如何解决一系列科学问题并且可以被成功借鉴到其他相近的领域。

文章第一作者为来自北京大学物理学院、即将加入人工智能研究院读博的胡逸。胡逸的导师为北京大学人工智能研究院助理教授、北京通用人工智能研究院研究员张牧涵,主要研究方向为图机器学习和大模型的推理和微调。

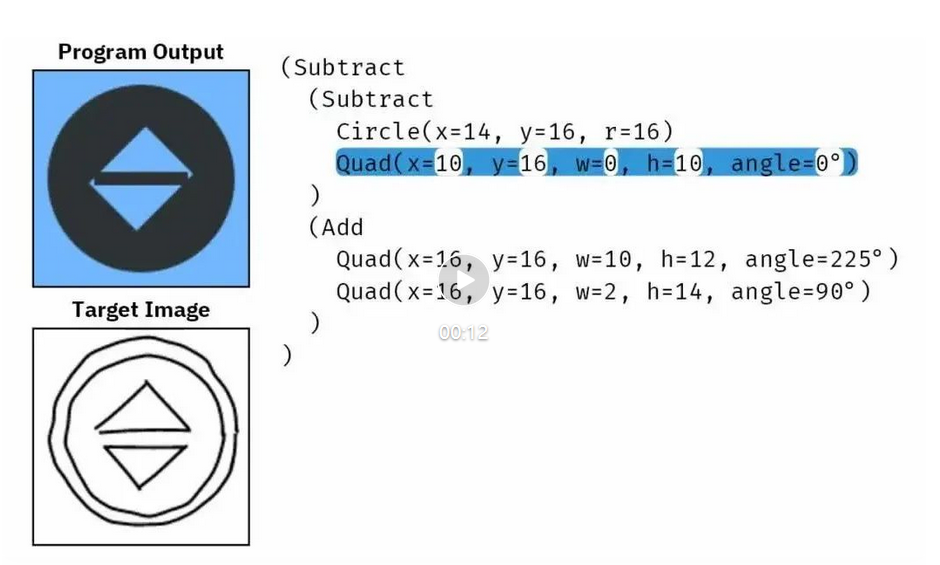

事实证明,扩散模型不仅能用于生成图像和视频,也能用于合成新程序。

本文提出了解决一般性编辑任务的统一框架!近期,复旦大学 FVL 实验室和南洋理工大学的研究人员对于多模态引导的基于文生图大模型的图像编辑算法进行了总结和回顾。综述涵盖 300 多篇相关研究,调研的最新模型截止至今年 6 月!

性能翻倍的Gemma 2, 让同量级的Llama3怎么玩?

想要达成通用人工智能 AGI 的终极目标,首先要达成的是模型要能完成人类所能轻松做到的任务。为了做到这一点,大模型开发的关键指导之一便是如何让机器像人类一样思考和推理。诸如注意力机制和思维链(Chain-of-Thought)等技术正是由此产生的灵感。

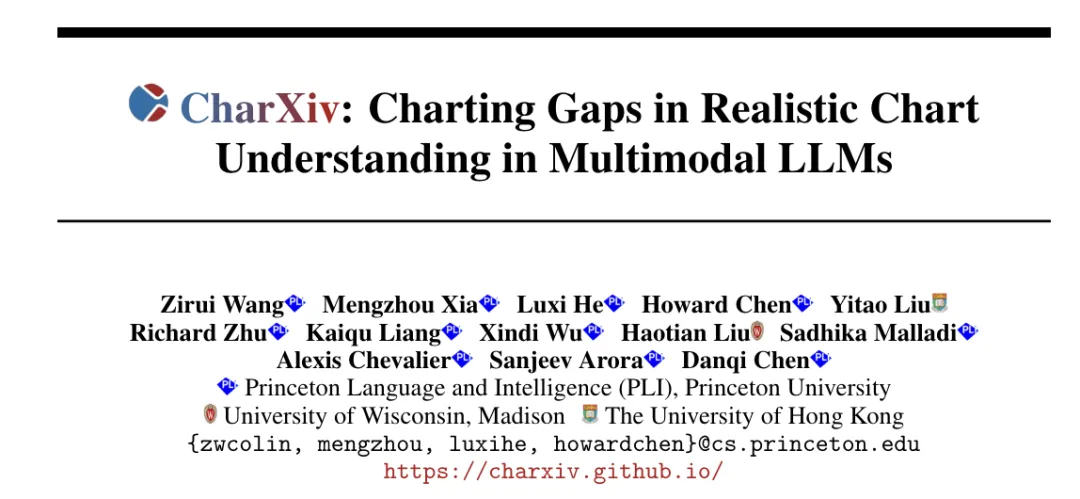

Claude 3.5 Sonnet的图表推理能力,比GPT-4o高出了27.8%。 针对多模态大模型在图表任务上的表现,陈丹琦团队提出了新的测试基准。 新Benchmark比以往更有区分度,也让一众传统测试中的高分模型暴露出了真实能力。

谷歌开源模型Gemma 2开放了! 虽然前段时间Google I/O大会上,Gemma 2开源的消息就已经被放出,但谷歌还留了个小惊喜—— 除27B模型外,还有一个更轻的9B版本。 DeepMind创始人哈萨比斯表示,27B参数规模下,Gemma 2提供了同类模型最强性能,甚至还能与其两倍大的模型竞争。

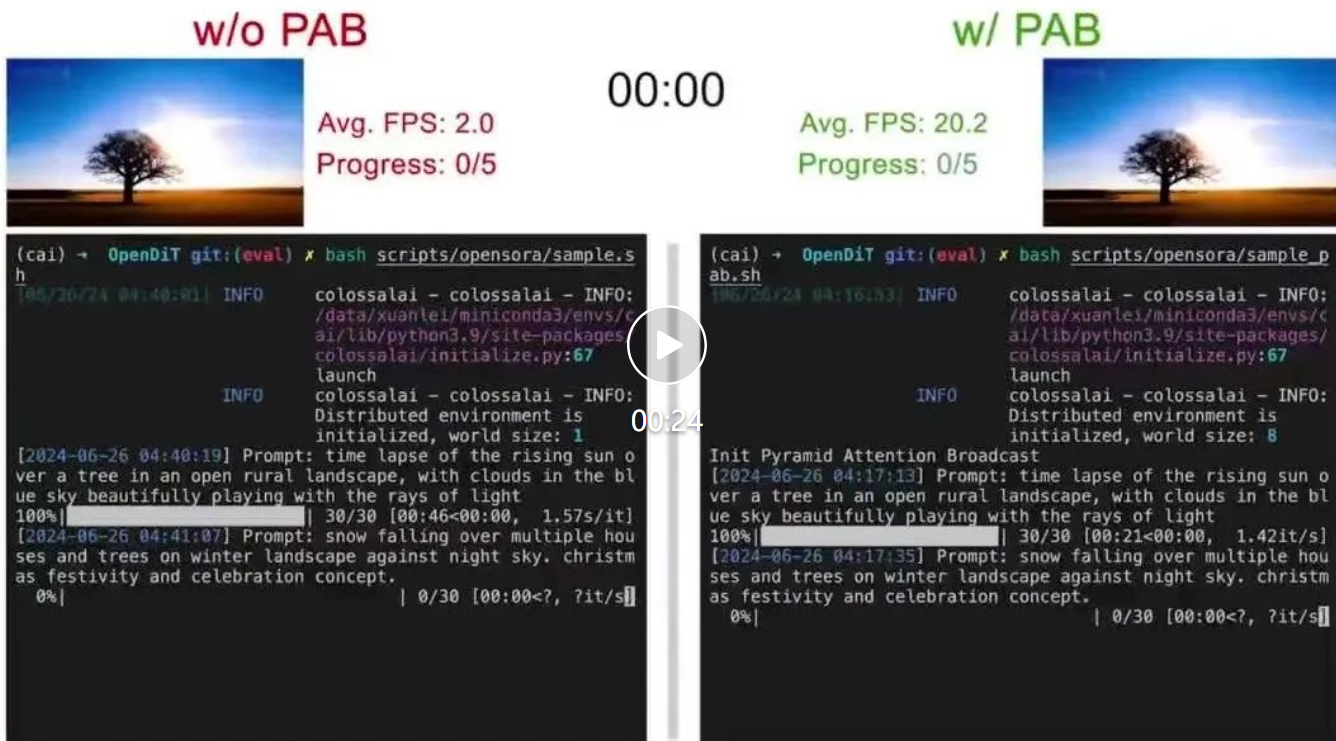

尤洋团队新作,首个基于DiT的实时视频生成方法来了!

人在华东师范大学,上课、教学已经用上了大模型。

计算机程序可以生成很像真随机的「伪随机数」,而LLM表示,干脆不装了,我就有自己最喜欢的数。

本文将为大家介绍CVPR 2024 Highlight的论文LangSplat: 3D Language Gaussian Splatting(三维语义高斯泼溅)。LangSplat在开放文本目标定位和语义分割任务上达到SOTA性能。在1440×1080分辨率的图像上,查询速度比之前的SOTA方法LERF快了199倍。代码已开源。

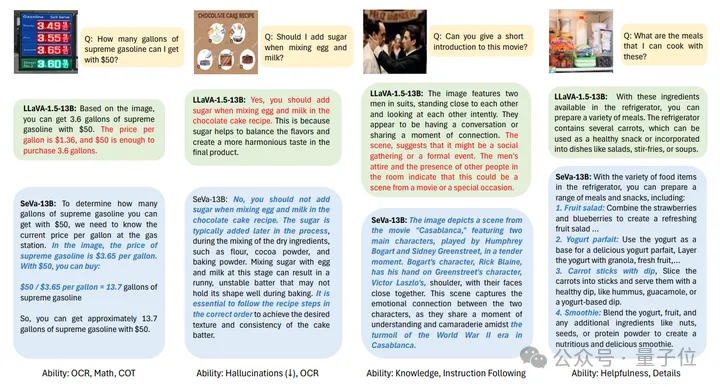

在当今的多模态大模型的发展中,模型的性能和训练数据的质量关系十分紧密,可以说是 “数据赋予了模型的绝大多数能力”。

上下文学习 (in-context learning, 简写为 ICL) 已经在很多 LLM 有关的应用中展现了强大的能力,但是对其理论的分析仍然比较有限。人们依然试图理解为什么基于 Transformer 架构的 LLM 可以展现出 ICL 的能力。

面对层出不穷的个性化图像生成技术,一个新问题摆在眼前:缺乏统一标准来衡量这些生成的图片是否符合人们的喜好。对此,来自清华、西交大、伊利诺伊厄巴纳-香槟分校、中科院、旷视的研究人员共同推出了一项新基准DreamBench++。

如何在有限的内存下实现高效的大模型推理,是端侧AI发展的重要任务。

超越扩散模型!自回归范式在图像生成领域再次被验证——

天津大学量子智能与语言理解团队创新性地将量子计算引入隐式神经表征领域,提出了量子隐式表征网络(Quantum Implicit Representation Network, QIREN)。

当前的多模态和多任务基础模型,如 4M 或 UnifiedIO,显示出有希望的结果。然而,它们接受不同输入和执行不同任务的开箱即用能力,受到它们接受训练的模态和任务的数量(通常很少)的限制。

自 OpenAI 的 Q* 项目曝光后,引发业内众多讨论。据现有信息汇总,Q* 项目被视作 OpenAI 在探索人工通用智能(Artificial General Intelligence, AGI)道路上的一次重大尝试,有望在包括数学问题解决能力、自主学习和自我改进等多个层面对人工智能技术带来革新性突破。

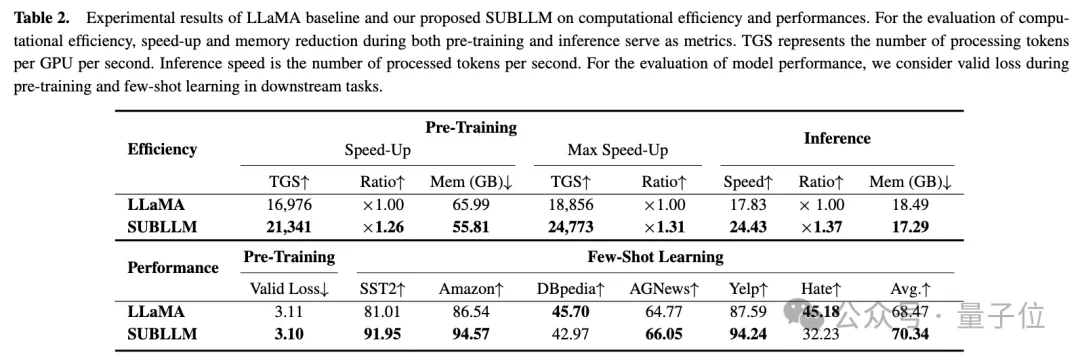

大模型推理速度提升50%以上,还能保证少样本学习性能!

AI技术日新月异,近来Anthropic公司最新发布的Claude-3.5-Sonnet因在知识型推理、数学推理、编程任务及视觉推理等任务上设立新行业基准而引发广泛讨论

方向完全搞错了?

等了半年,微软视觉基础模型Florence-2终于开源了。它能够根据提示,完成字幕、对象检测、分割等各种计算机视觉和语言的任务。网友们实测后,堪称「游戏规则改变者」。

是时候把数据Scale Down了!Llama 3揭示了这个可怕的事实:数据量从2T增加到15T,就能大力出奇迹,所以要想要有GPT-3到GPT-4的提升,下一代模型至少还要150T的数据。好在,最近有团队从CommonCrawl里洗出了240T数据——现在数据已经不缺了,但你有卡吗?

不用打标签,也能解决视觉大模型的偏好对齐问题了。

入选CVPR 2024 Highlight的三维语义高斯泼溅最新成果,查询速度比之前的SOTA方法LERF快了199倍!

3D场景理解让人形机器人「看得见」周身场景,使汽车自动驾驶功能能够实时感知行驶过程中可能出现的情形,从而做出更加智能化的行为和反应。而这一切需要大量3D场景的详细标注,从而急剧提升时间成本和资源投入。

在人工智能领域的发展过程中,对大语言模型(LLM)的控制与指导始终是核心挑战之一,旨在确保这些模型既强大又安全地服务于人类社会。早期的努力集中于通过人类反馈的强化学习方法(RLHF)来管理这些模型,成效显著,标志着向更加人性化 AI 迈出的关键一步。