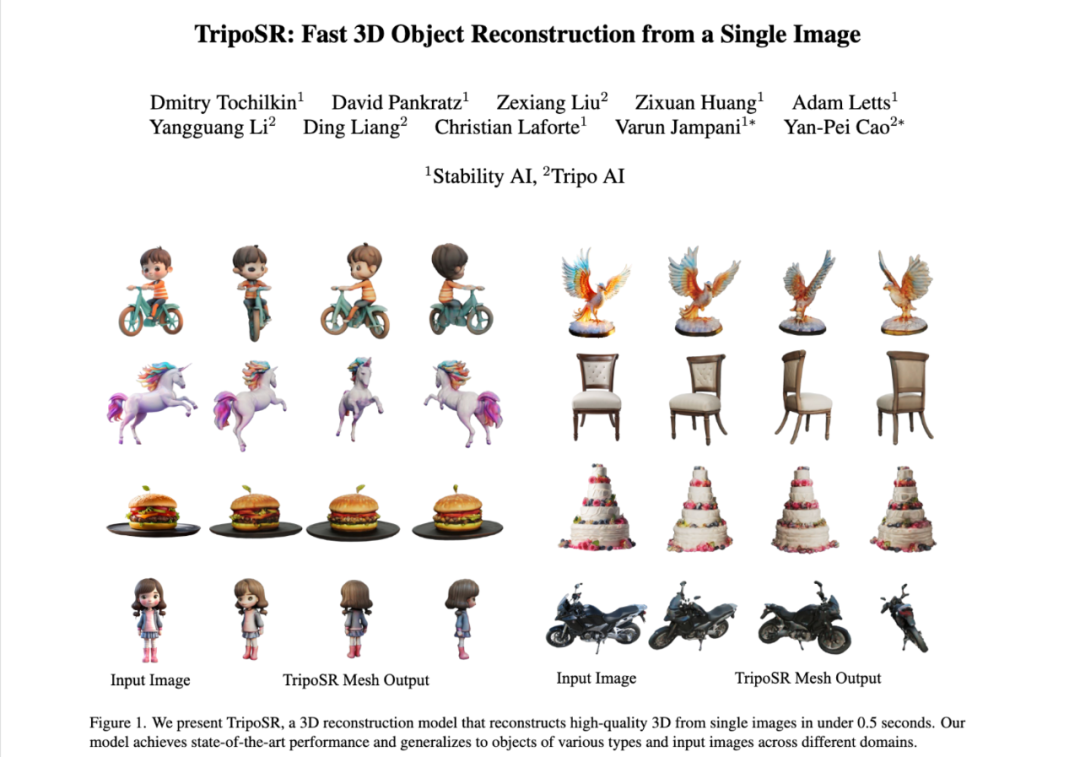

0.5秒,无需GPU,Stability AI与华人团队VAST开源单图生成3D模型TripoSR

0.5秒,无需GPU,Stability AI与华人团队VAST开源单图生成3D模型TripoSR最近,文生视频模型 Sora 掀起了新一轮生成式 AI 模型浪潮,模型的多模态能力引起广泛关注。

最近,文生视频模型 Sora 掀起了新一轮生成式 AI 模型浪潮,模型的多模态能力引起广泛关注。

Sora 的发布让整个 AI 领域为之狂欢,但 LeCun 是个例外。

谷歌在语言和声控计算机界面的漫长道路上又迈出了重要一步。最新ScreenAI视觉语言模型,能够完成各种屏幕QA问答、总结摘要等任务。

最近,OpenAI 的视频生成模型 Sora 爆火,生成式 AI 模型在多模态方面的能力再次引起广泛关注。

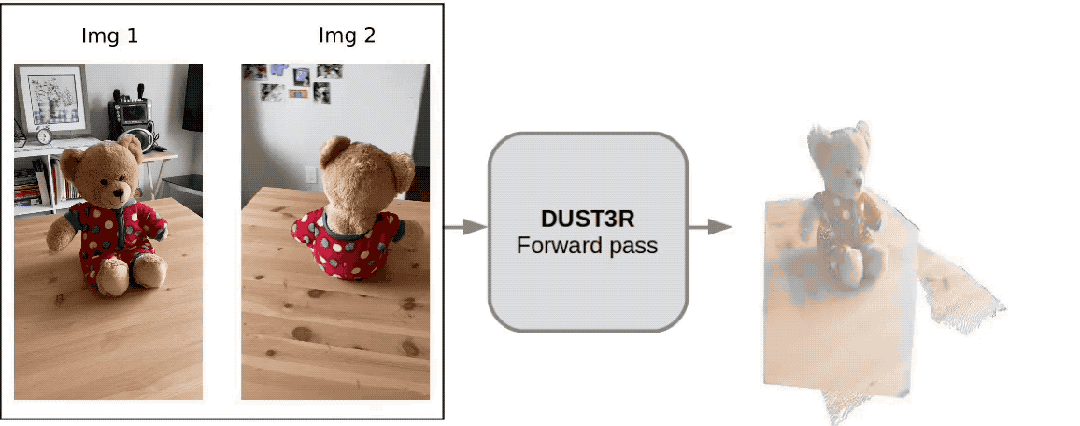

这个名为DUSt3R的新工具,火得一塌糊涂,才上线没多久就登上GitHub热榜第二。

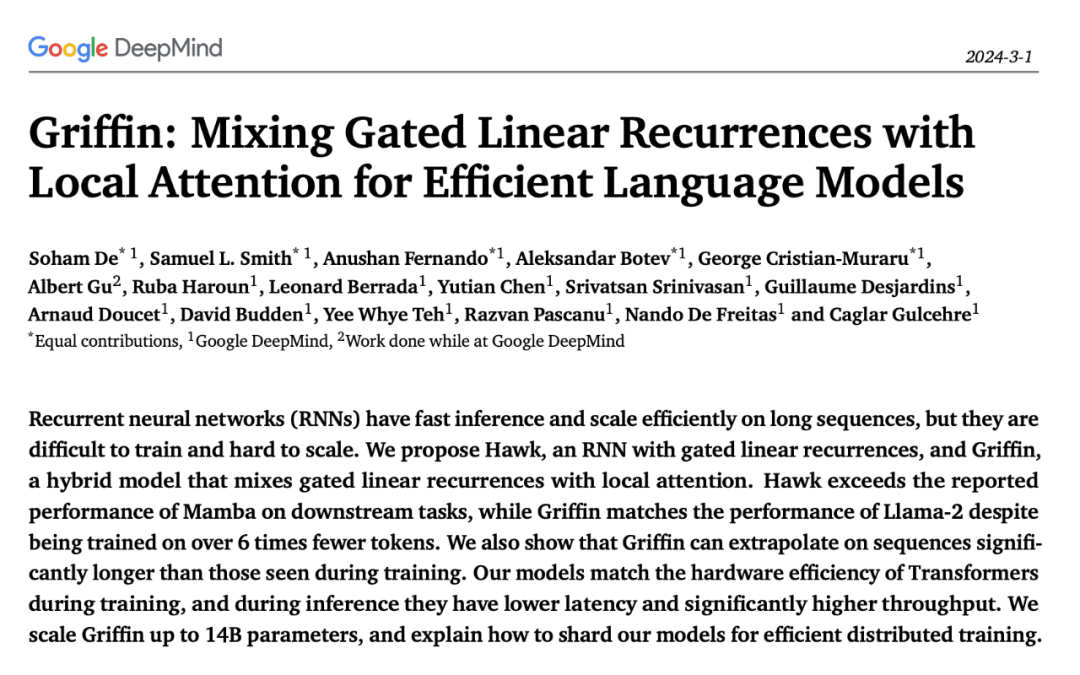

去年 12 月,新架构 Mamba 引爆了 AI 圈,向屹立不倒的 Transformer 发起了挑战。如今,谷歌 DeepMind「Hawk 」和「Griffin 」的推出为 AI 圈提供了新的选择。

近期,清华大学和哈尔滨工业大学联合发布了一篇论文:把大模型压缩到 1.0073 个比特时,仍然能使其保持约 83% 的性能!

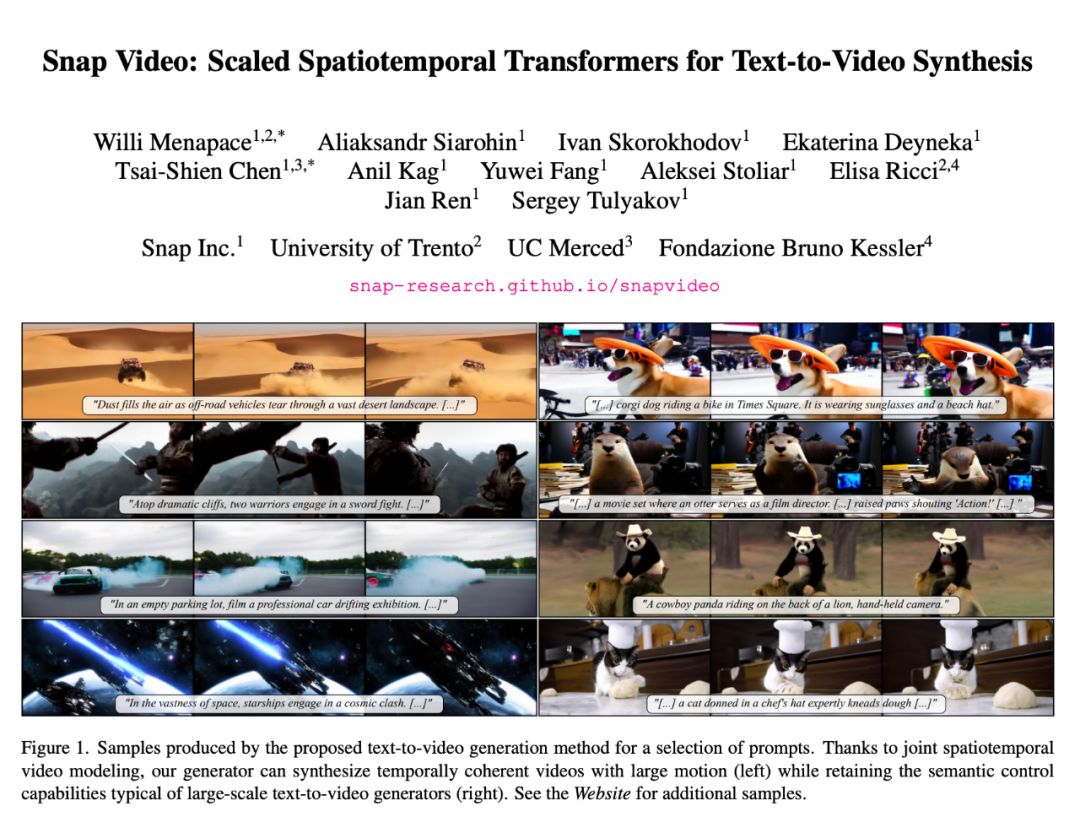

随着 Sora 的爆火,人们看到了 AI 视频生成的巨大潜力,对这一领域的关注度也越来越高。

只靠一张物体图片,大语言模型就能控制机械臂完成各种日常物体操作吗?

谷歌DeepMind、UC伯克利和MIT的研究人员认为,如果用大语言模型的思路来做大视频模型,能解决很多语言模型不擅长的问题,可能能更进一步接近世界模型。

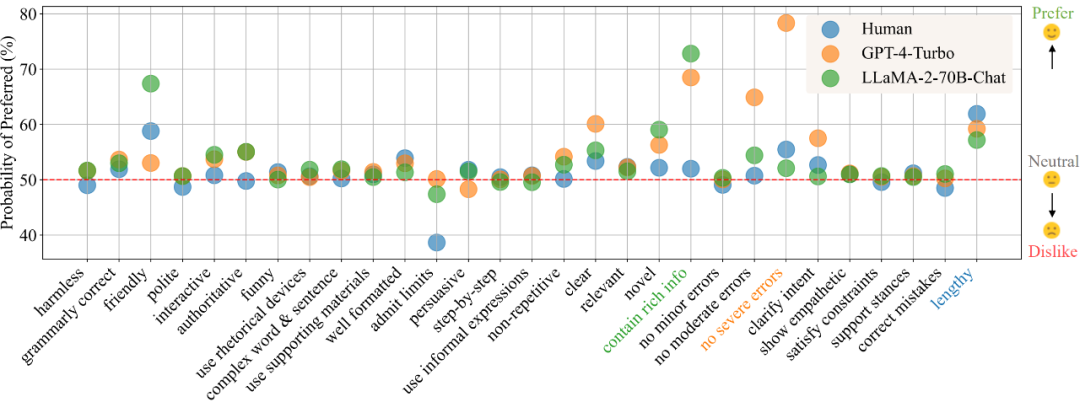

在目前的模型训练范式中,偏好数据的的获取与使用已经成为了不可或缺的一环。在训练中,偏好数据通常被用作对齐(alignment)时的训练优化目标,如基于人类或 AI 反馈的强化学习(RLHF/RLAIF)或者直接偏好优化(DPO),而在模型评估中,由于任务的复杂性且通常没有标准答案,则通常直接以人类标注者或高性能大模型(LLM-as-a-Judge)的偏好标注作为评判标准。

有人表示:「等待已久的 AI 图像创建功能终于迎来了图层!」

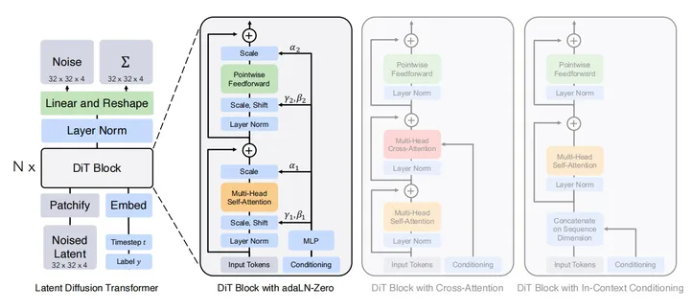

Sora刚发布不久,就被逆向工程“解剖”了?!

GPT早已成为大模型时代的基础。国外一位开发者发布了一篇实践指南,仅用60行代码构建GPT。

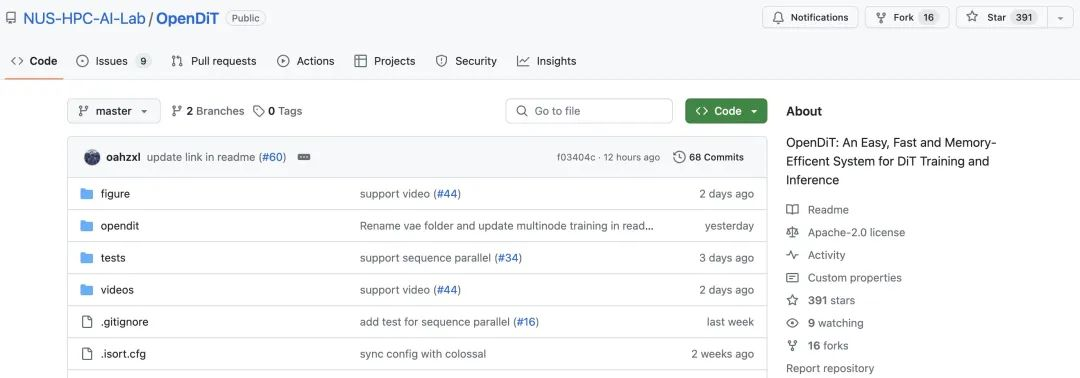

最近,OpenAI 视频生成模型 Sora 的爆火,给基于 Transformer 的扩散模型重新带来了一波热度,比如 Sora 研发负责人之一 William Peebles 与纽约大学助理教授谢赛宁去年提出的 DiT(Diffusion Transformer)。

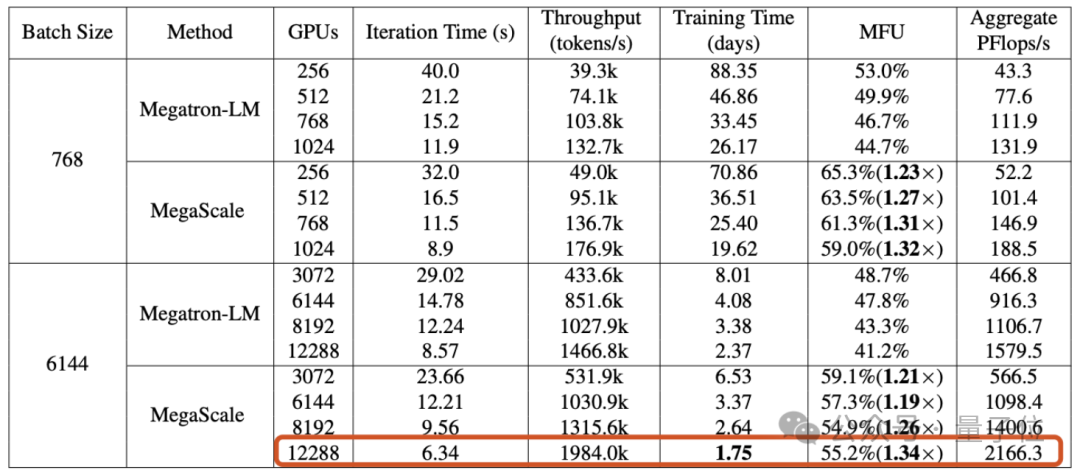

随着对Sora技术分析的展开,AI基础设施的重要性愈发凸显。

许久未更新大模型的英伟达推出了150亿参数的Nemotron-4,目标是打造一个能在单个A100/H100可跑的通用大模型。

本文提出了扩散模型中UNet的long skip connection的scaling操作可以有助于模型稳定训练的分析,目前已被NeurIPS 2023录用。同时,该分析还可以解释扩散模型中常用但未知原理的1/√2 scaling操作能加速训练的现象。

有了阿里的 EMO,AI 生成或真实的图像「动起来说话或唱歌」变得更容易了。

今天凌晨,由微软、国科大等机构提交的一篇论文在 AI 圈里被人们争相转阅。该研究提出了一种 1-bit 大模型,实现效果让人只想说两个字:震惊。

LLaMa 3 正寻找安全与可用性的新平衡点。

根据 OpenAI 披露的技术报告,Sora 的核心技术点之一是将视觉数据转化为 patch 的统一表征形式,并通过 Transformer 和扩散模型结合,展现了卓越的扩展(scale)特性。

现在,大语言模型(LLM)迎来了“1-bit时代”。

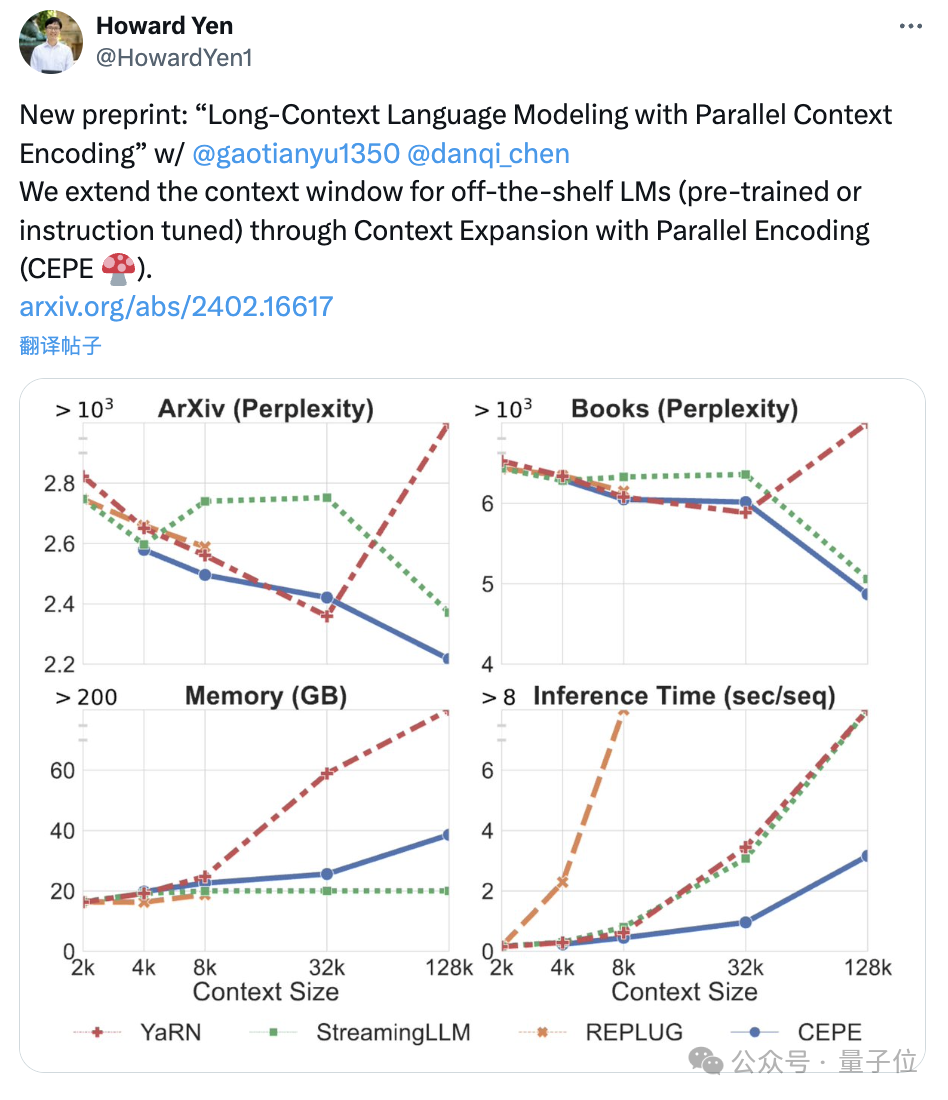

陈丹琦团队刚刚发布了一种新的LLM上下文窗口扩展方法:它仅用8k大小的token文档进行训练,就能将Llama-2窗口扩展至128k。

用过ChatGPT的人知道,新时代来临了。Sora的出现,将人工智能推向新高潮。

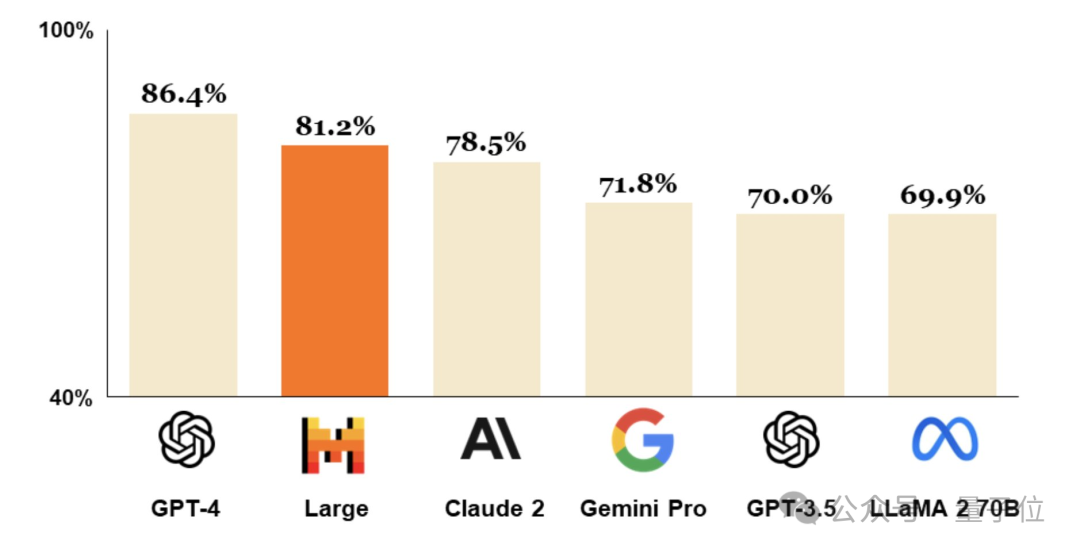

成立仅9个月,法国Mistral AI拿出仅次于GPT-4的大模型。

全新消费级显卡,专为提速笔记本大模型应用而生。

2月22日,英伟达发布2024财年四季报,营收221亿美元,同比增长265%,净利润123亿美元,同比激增769%,双双大超市场预期。

AI x 机器人正逐渐走上时代的风口,近日,谷歌DeepMind以及英伟达两家AI大厂都在机器人领域有所动作。

英伟达发布移动工作站产品线最后一块拼图,号称与竞品相比效率提升14倍。随着今年大量AI消费级硬件的上市,AI应用的门槛彻底被老黄打下来了。