字节发完阿里发!Qwen-Image 2.0火线出击

字节发完阿里发!Qwen-Image 2.0火线出击今天,阿里巴巴发布了新一代图像生成基础模型Qwen-Image 2.0,这一模型支持长达一千个token的超长指令、2k分辨率,并采用了更轻量的模型架构,模型尺寸远小于Qwen-Image 2.0的20B,带来更快的推理速度。

搜索

搜索

今天,阿里巴巴发布了新一代图像生成基础模型Qwen-Image 2.0,这一模型支持长达一千个token的超长指令、2k分辨率,并采用了更轻量的模型架构,模型尺寸远小于Qwen-Image 2.0的20B,带来更快的推理速度。

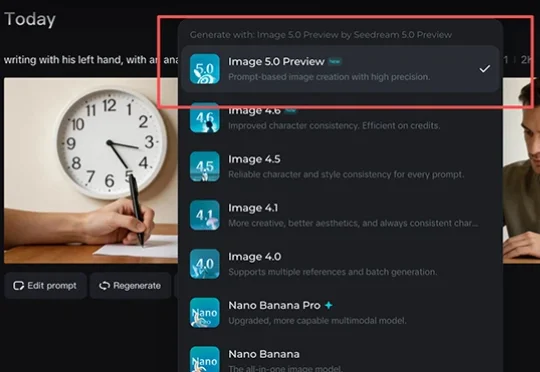

新模型对标Nano Banana Pro,能免费体验。Seedance 2.0的热度还没下去,字节新模型又来了!今日,字节图像生成模型Seedream 5.0 Preview在视频编辑应用剪映、剪映海外版Capcut、字节AI创作平台小云雀均已上线,在即梦AI平台开启灰度测试,图片生成可限时免费体验。

这两天,AI 视频圈被偷摸摸上线的 Seedance 2.0 刷屏了。在 AI 视频领域颇有影响力的博主海辛,在即刻分享了自己对它的观点:「Seedance 2.0 是我 26 年来最大的震撼」、「我觉得它碾压 Sora2」。

2月7日,字节跳动AI视频生成模型Seedance2.0开启灰度测试,该模型支持文本、图片、视频、音频素材输入,可以完成自分镜和自运镜,镜头移动后人物特征能够保持一致。

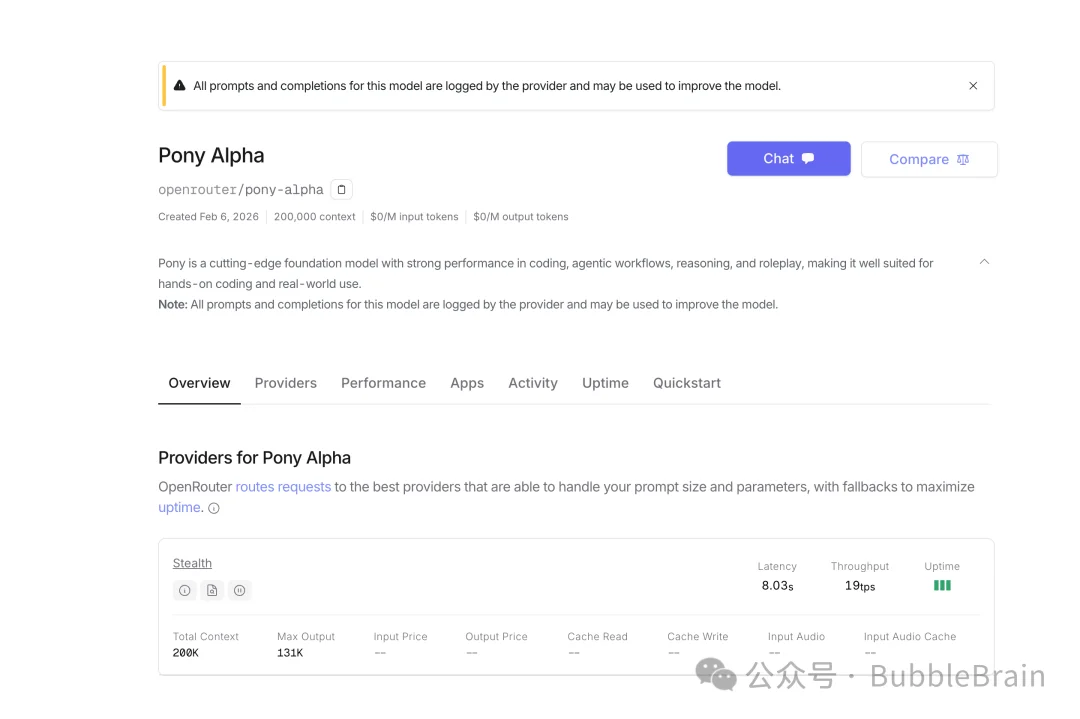

这周真的特别期待,应该可以看到各路厂商神仙打架。这股战火,从周末就开始了。 除了字节发布的Seedance2.0以外,还有个神秘的模型Pony Alpha 也上线到OpenRouter了,已经看到很多网友们纷纷猜测到底是谁家的模型。

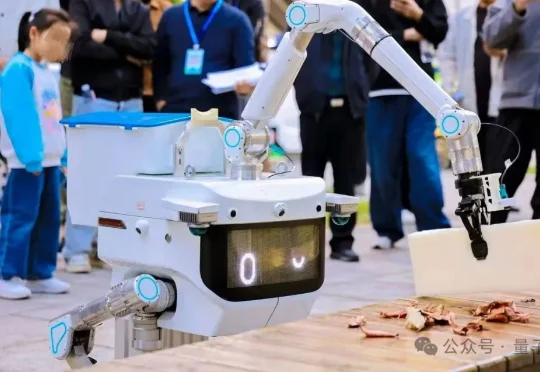

作为具身智能领域的代表性玩家,由上海交大系技术“双子星”——何弢博士与廖文龙博士联手掌舵的酷哇科技(Coowa),近期发布了其核心技术底座——COOWA WAM 2.0世界模型。

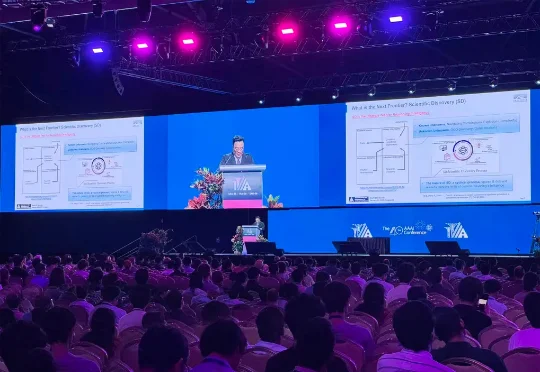

周伯文还详细介绍了上海 AI 实验室近年来开展的前沿探索与实践,包括驱动 “通专融合” 发展的技术架构 ——“智者”SAGE(Synergistic Architecture for Generalizable Experts),其包含基础、融合与进化三个层次,并可双向循环实现全栈进化;支撑 AGI4S 探索的两大基础设施“书生”科学多模态大模型 Intern-S1、“

大家好,我是最近天天折腾CLI Agent的袋鼠帝。 一周前,我给大家安利了一款Claude Code的最强开源对手:OpenCode,没想到文章发出去后反响这么热烈,不管是阅读量还是评论都非常多。刚好,前几天我看到腾讯的CodeBuddy Code重磅升级到了2.0版本。说实话,CodeBuddy Code我有用过,基本完全复刻Claude Code,之前还帮我开发了好几个小工具,很实用。

一个曾被Cursor官方盖章认定的全球前0.01%顶级玩家,却在Claude Code 2.0发布后果断「倒戈」!这不只是换工具,而是底层的游戏规则已经悄悄换了。

但扣子 2.0 做的事情,不只是跟进 Skill 这个概念:它想要把 Skill 与「扣子编程」深度融合,从而打造一整套「职场 AI」解决方案。