我花300块组装的电脑,成功跑通了本地大模型

我花300块组装的电脑,成功跑通了本地大模型如果说2023年是大家公认的AI元年,那么2024年很可能就是AI大模型普及的关键一年。 在这一年里,大量的AI大模型、大量的AI应用问世,Meta、Google等厂商也开始面向民众推出自己的在线/本地大模型,似乎“AI人工智能”瞬间从一个遥不可及的概念,就这么突然来到了人们身边。

搜索

搜索

如果说2023年是大家公认的AI元年,那么2024年很可能就是AI大模型普及的关键一年。 在这一年里,大量的AI大模型、大量的AI应用问世,Meta、Google等厂商也开始面向民众推出自己的在线/本地大模型,似乎“AI人工智能”瞬间从一个遥不可及的概念,就这么突然来到了人们身边。

2024年伊始,步入了大模型应用元年的企服市场,就已经沉淀出了诸多感悟。生成式AI解决的是产品能力和实际数据价值的匮乏,武装的是企业的手。可国内企业客户花了一笔钱要当成十笔来提需求的“重服务情结”,卡的是企服的腰腹部位。

首位超越国际奥林匹克竞赛金牌得主的AI,刚刚诞生了!

大语言模型(LLM),通过在海量数据集上的训练,展现了超强的多任务学习、通用世界知识目标规划以及推理能力

Meta 正在不遗余力地想要在生成式 AI 领域赶上竞争对手,目标是投入数十亿美元用于 AI 研究。这些巨资一部分用于招募 AI 研究员。但更大的一部分用于开发硬件,特别是用于运行和训练 Meta AI 模型的芯片

一个仅用 1000 行代码即可在 CPU/fp32 上实现 GPT-2 训练的项目「llm.c」

laude 3 具有非常大的内存( 200k 上下文窗口)和很强的调用准确性,它的上下文能力也因此成为最受欢迎、应用最广的技能。我们介绍过如何利用这种能力,没时间收听播客也能获取核心内容。今天,我们再介绍一个新技能,帮助技术小白快速 get 最新、最前沿的科技成果

这款产品会将现有的两个空间计算的产品线(Quest 3 和雷朋 Meta 智能眼镜)整合起来,形成AI+AR眼镜的新形态产品。

纯C语言训练GPT,1000行代码搞定!,不用现成的深度学习框架,纯手搓。 发布仅几个小时,已经揽星2.3k。

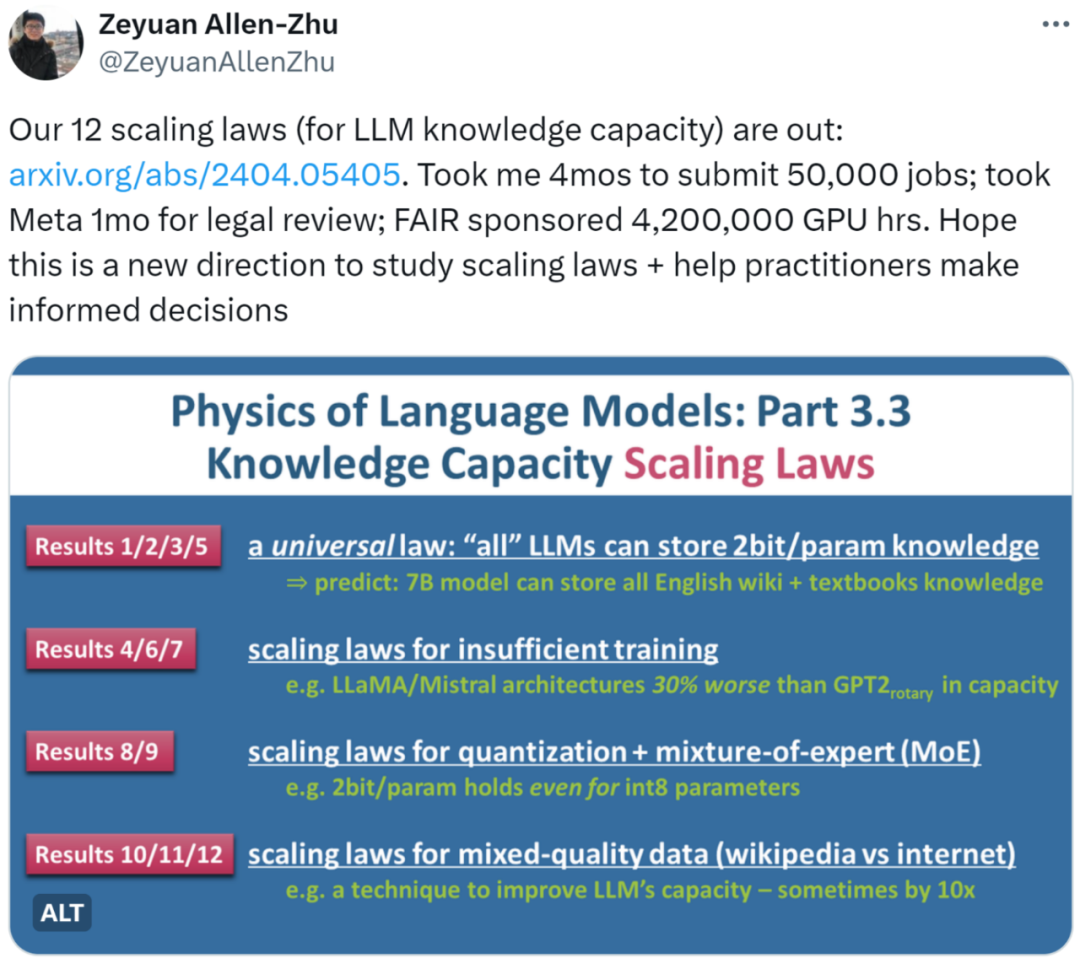

近日,朱泽园 (Meta AI) 和李远志 (MBZUAI) 的最新研究《语言模型物理学 Part 3.3:知识的 Scaling Laws》用海量实验(50,000 条任务,总计 4,200,000 GPU 小时)总结了 12 条定律,为 LLM 在不同条件下的知识容量提供了较为精确的计量方法。