ICML 2024高分论文 | 零阶优化器微调大模型,大幅降低内存

ICML 2024高分论文 | 零阶优化器微调大模型,大幅降低内存开源大语言模型(LLM)百花齐放,为了让它们适应各种下游任务,微调(fine-tuning)是最广泛采用的基本方法。基于自动微分技术(auto-differentiation)的一阶优化器(SGD、Adam 等)虽然在模型微调中占据主流,然而在模型越来越大的今天,却带来越来越大的显存压力。

开源大语言模型(LLM)百花齐放,为了让它们适应各种下游任务,微调(fine-tuning)是最广泛采用的基本方法。基于自动微分技术(auto-differentiation)的一阶优化器(SGD、Adam 等)虽然在模型微调中占据主流,然而在模型越来越大的今天,却带来越来越大的显存压力。

神经网络通常由三部分组成:线性层、非线性层(激活函数)和标准化层。线性层是网络参数的主要存在位置,非线性层提升神经网络的表达能力,而标准化层(Normalization)主要用于稳定和加速神经网络训练,很少有工作研究它们的表达能力,例如,以Batch Normalization为例

全球首款AI短剧APP「Reel.AI」发布,获百度投资。

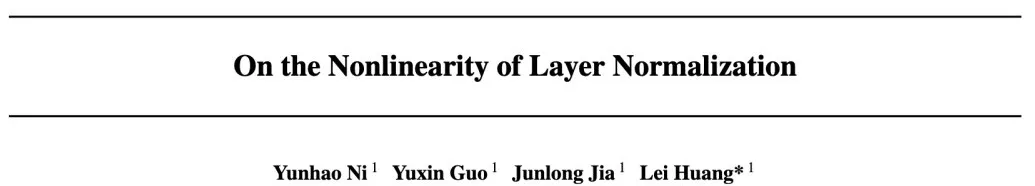

自从大模型爆火以来,语义检索也逐渐成为一项热门技术。尤其是在 RAG(retrieval augmented generation)应用中,检索结果的相关性直接决定了 AI 生成的最终效果。

加速药物开发和临床试验的效率。

从MIT辍学后,华裔少年Alexandr Wang开始建立自己的初创公司,从此开始走向人生巅峰。押对数据标注方向后,他在27岁时就成为了亿万富翁。The Information刚刚发了长文,爆料了Wang的公司崛起的内幕。

在当今的多模态大模型的发展中,模型的性能和训练数据的质量关系十分紧密,可以说是 “数据赋予了模型的绝大多数能力”。

最近,OpenAI首席技术官Mira Murati回到母校参加访谈,一句话惹了众怒。一些创造性的工作可能会消失,但也许它们本就不该存在。

工具使用(Tool Use)和个性化记忆(Personalization Memory)是目前AI Agent最重要的基础设施

近日,清华大学与密歇根大学联合提出的自动驾驶汽车安全性「稀疏度灾难」问题,发表在了顶刊《Nature Communications》上。研究指出,安全攸关事件的稀疏性导致深度学习模型训练难度大增,提出了密集学习、模型泛化改进和车路协同等技术路线以应对挑战。