让龙虾看懂屏幕!谷歌多模态新成果,文本图像视频音频进同一空间

让龙虾看懂屏幕!谷歌多模态新成果,文本图像视频音频进同一空间刚刚,谷歌发布了首个原生多模态(Multimodal)嵌入模型——Gemini Embedding 2。这次模型最大的变化在于:把文本、图像、视频、音频和文档,全部映射进同一个统一的嵌入空间。

刚刚,谷歌发布了首个原生多模态(Multimodal)嵌入模型——Gemini Embedding 2。这次模型最大的变化在于:把文本、图像、视频、音频和文档,全部映射进同一个统一的嵌入空间。

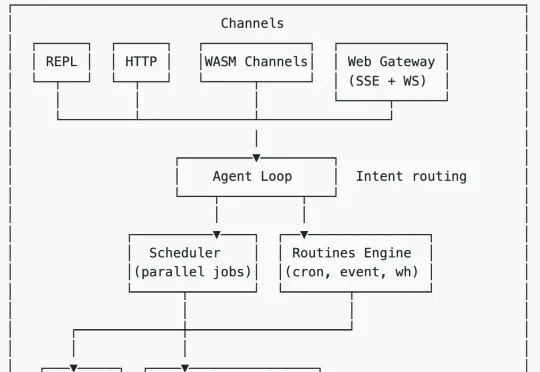

OpenClaw 爆火之后,我一直在想一个问题: 如果把 AI Agent 当作一个员工来看,未来最重要的能力是什么?

春节期间, Seedance 2.0 爆火,堪称现象级,这也再次把视频生成推上风口。前两天,字节跳动又携手北大、安努智能和 Canva 共同开源了具备实时生成能力的视频模型 Helios 家族。该系列包含了 Helios-Base、Helios-Mid 与 Helios-Distilled 三个版本,全面覆盖了 T2V、I2V、V2V 以及交互式生成任务。

基础模型时代,大模型能力的爆发,很大程度上源于在海量文本上的预训练。然而问题在于,文本本质上只是人类对现实世界的一种抽象表达,是对真实世界信息的有损压缩。

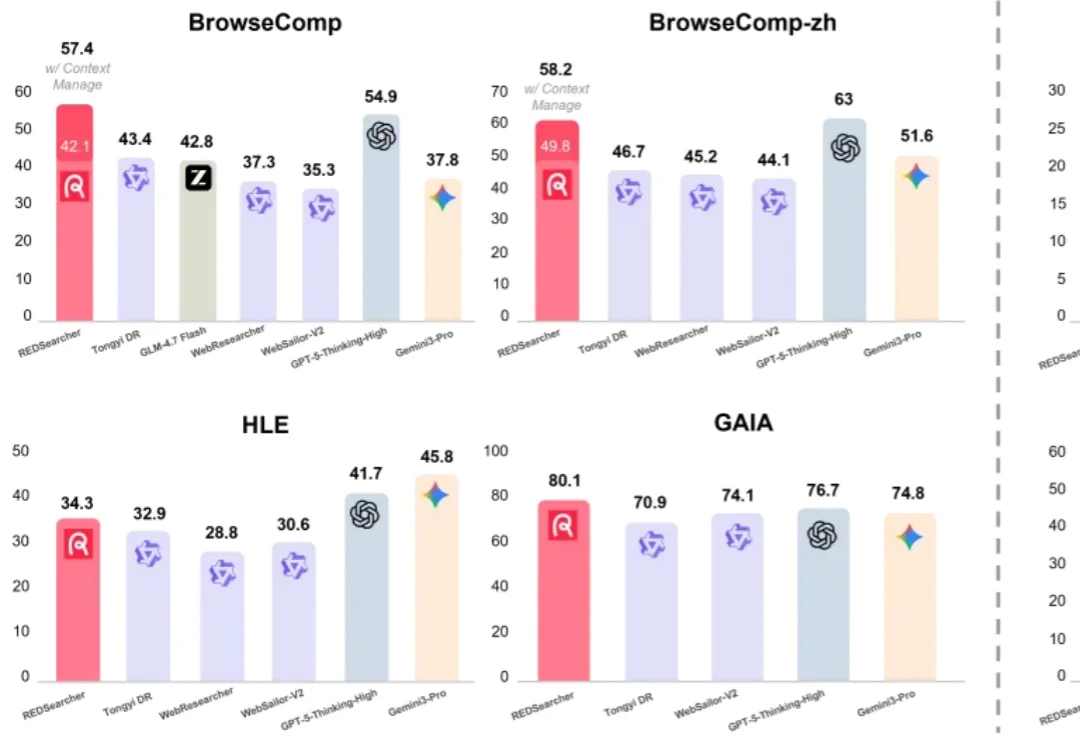

「2018 到 2023 年间在 EMNLP 会议上发表的那篇论文中,第一作者本科就读于达特茅斯学院、第四作者本科就读于宾夕法尼亚大学的那篇科学论文,题目是什么?」

面对 OpenClaw(龙虾)可能存在的「恶意利用用户数据和资金」的重大风险,Transformer 八子之一 Illia Polosukhin 出手了。今天,Illia Polosukhin 在 Reddit 上发了一则帖子,深谈了其使用 Rust 来构建安全版 OpenClaw 的心路历程,引起了热议。

3月6日,腾讯混元发布了一篇名为“HY-WU (Part I): An Extensible Functional Neural Memory Framework and An Instantiation in Text-Guided Image Editing”的技术报告。提出了一种崭新的功能性记忆(functional neural memory)范式(weight unleashing),

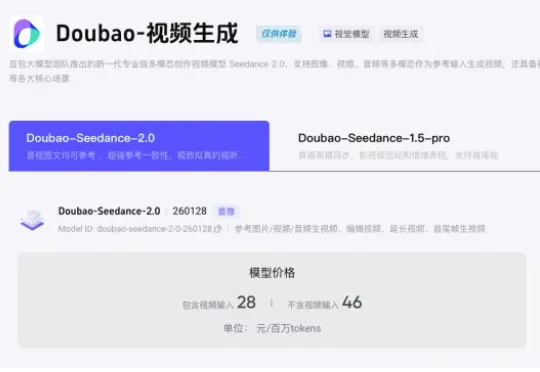

火山引擎官网,现已公布Seedance 2.0模型定价。包含视频输入的价格是28元/百万tokens,不含视频输入的价格则是46元/百万tokens。使用Seedance 2.0生成一条15秒的标准视频(720p,24fps),大概要消耗30.888万tokens。

让AI自己写高性能GPU代码,字节Seed与清华AIR团队做到了。

Seedance 2.0 有多火爆,这几天国内外网友分享的实测视频,或许都能略窥一二。