8B尺寸达到GPT-4级性能!北大等提出医疗专家模型训练方法

8B尺寸达到GPT-4级性能!北大等提出医疗专家模型训练方法本文研究发现大语言模型在持续预训练过程中出现目标领域性能先下降再上升的现象。

本文研究发现大语言模型在持续预训练过程中出现目标领域性能先下降再上升的现象。

人工智能(AI)在过去十年里取得了长足进步,特别是在自然语言处理和计算机视觉领域。然而,如何提升 AI 的认知能力和推理能力,仍然是一个巨大的挑战。

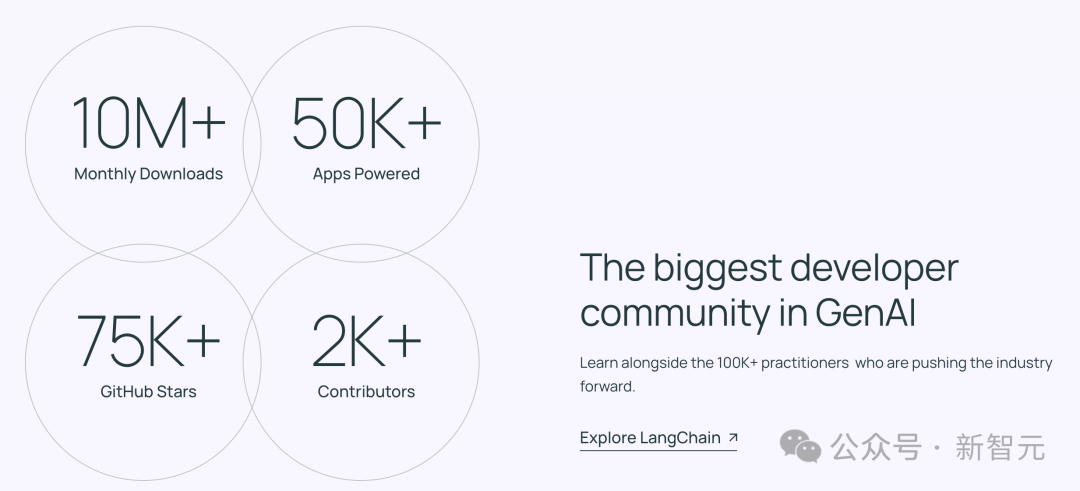

最近,Hacker News热榜上出现了一篇「声讨」LangChain的技术文章,得到了评论区网友的一致呼应。去年还火遍LLM圈的LangChain,为什么口碑逆转了?

LLM能否解决「狼-山羊-卷心菜」经典过河难题?最近,菲尔兹奖得主Timothy Gowers分享了实测GPT-4o的过程,模型在最简单的题目上竟然做错了,甚至网友们发现,就连Claude 3.5也无法幸免。

Meta搞了个很牛的LLM Compiler,帮助程序员更高效地写代码。

谷歌作为全球领先的科技公司,在 AI 领域拥有深厚的积累和卓越的创新能力,在谷歌眼里,生成式 AI 带来了哪些机会?Google AI 是如何在谷歌产品中落地的?Google Cloud 提供了一系列工具和平台,如何帮助开发者构建和部署自己的专属 LLM 和 Agent?负责任的 AI 为企业带来哪些价值?

计算机程序可以生成很像真随机的「伪随机数」,而LLM表示,干脆不装了,我就有自己最喜欢的数。

近日,首个多模态LLM视频分析综合评估基准Video-MME诞生!在这场全新的考试中,Gemini 1.5 Pro一路遥遥领先,谷歌首席科学家Jeff Dean更是愉快地连续转了3次推。

本文关注OpenAI近期的两次收购,从这两次收购背后,试图拼起OpenAI设计“未来操作系统--LLMOS”的巨大蓝图。

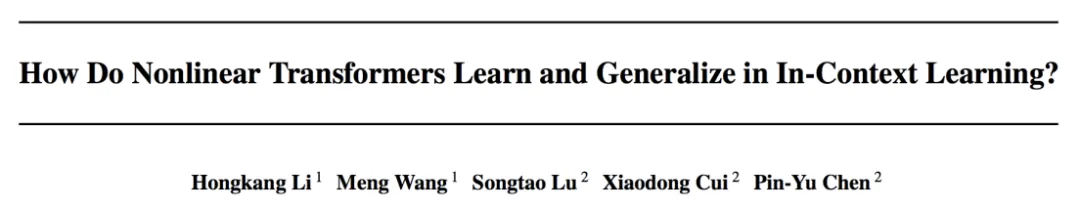

上下文学习 (in-context learning, 简写为 ICL) 已经在很多 LLM 有关的应用中展现了强大的能力,但是对其理论的分析仍然比较有限。人们依然试图理解为什么基于 Transformer 架构的 LLM 可以展现出 ICL 的能力。