微软、国科大开启1Bit时代:大模型转三进制,速度快4倍能耗降至1/41

微软、国科大开启1Bit时代:大模型转三进制,速度快4倍能耗降至1/41今天凌晨,由微软、国科大等机构提交的一篇论文在 AI 圈里被人们争相转阅。该研究提出了一种 1-bit 大模型,实现效果让人只想说两个字:震惊。

今天凌晨,由微软、国科大等机构提交的一篇论文在 AI 圈里被人们争相转阅。该研究提出了一种 1-bit 大模型,实现效果让人只想说两个字:震惊。

现在,大语言模型(LLM)迎来了“1-bit时代”。

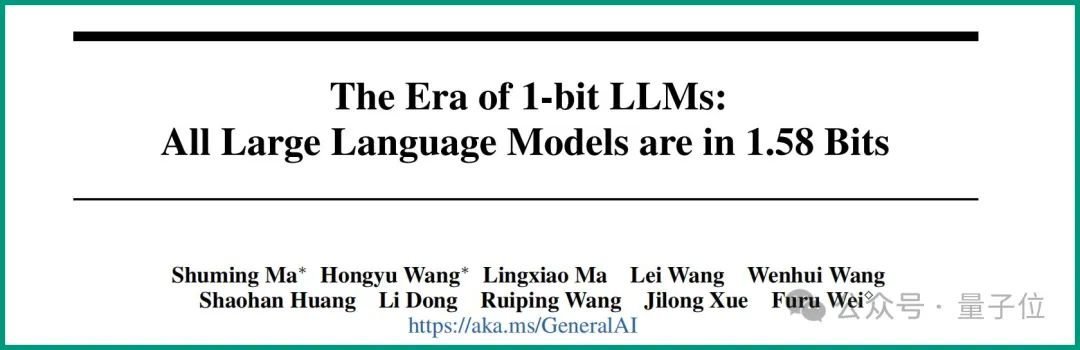

陈丹琦团队刚刚发布了一种新的LLM上下文窗口扩展方法:它仅用8k大小的token文档进行训练,就能将Llama-2窗口扩展至128k。

2月16日,OpenAI推出了堪称“王炸”的文生视频大模型Sora,AI军备竞赛的战场加速向多模态转移,这意味着相比寻常LLM更为丰富的场景与机会。此外,2024年将成为AI硬件元年的共识也基本形成,业界对AI在智能终端的应用寄予厚望,将其视为提振消费电子市场的关键。

随着大语言模型(LLMs)在近年来取得显著进展,它们的能力日益增强,进而引发了一个关键的问题:如何确保他们与人类价值观对齐,从而避免潜在的社会负面影响?

最近几天,Sora 成为了全世界关注的焦点。与之相关的一切,都被放大到极致。

谷歌DeepMind最新研究发现,问题中前提条件的呈现顺序,对于大模型的推理性能有着决定性的影响,打乱顺序能让模型表现下降30%。

「从头开始构建GPT分词器」文字版来了。

终有一天,LLM可以成为人类数据专家,针对不同领域进行数据分析,大大解放AI研究员。

最近几年,基于 Transformer 的架构在多种任务上都表现卓越,吸引了世界的瞩目。使用这类架构搭配大量数据,得到的大型语言模型(LLM)等模型可以很好地泛化用于真实世界用例。