UC伯克利发现GPT-4惊人缺陷:儿童从经验中学习因果,LLM却不行

UC伯克利发现GPT-4惊人缺陷:儿童从经验中学习因果,LLM却不行最近,UC伯克利的一项研究揭示了LLM和小孩子们在认知上的一项重要差别——创造新的因果结构的能力。

最近,UC伯克利的一项研究揭示了LLM和小孩子们在认知上的一项重要差别——创造新的因果结构的能力。

困扰数学家多年、让陶哲轩直呼喜欢的上限集问题数学难题,竟然被DeepMind的新算法破解了?这是史上首个用LLM发现的算法,堪称里程碑级研究,一经发布立马登Nature。

本文讨论了巨头AI受困于巨头垄断的问题,指出在线模型受商业壁垒限制,无法满足用户的个性化需求。文章以旅行计划为例,说明了通过本地部署的通用AI可以更好地满足用户需求。

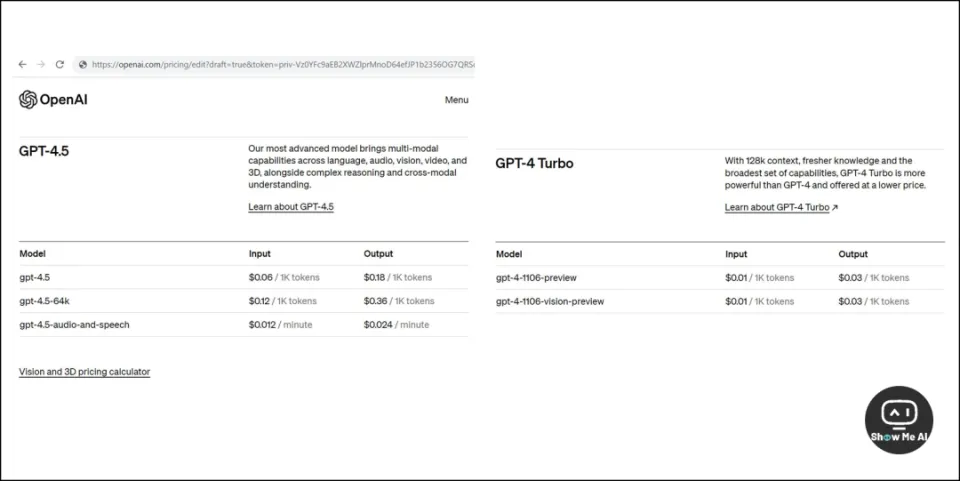

OpenAI GPT-4.5 遭泄露,我们即将见识「加强版」多模态大模型

大语言模型(LLM)被越来越多应用于各种领域。然而,它们的文本生成过程既昂贵又缓慢。这种低效率归因于自回归解码的运算规则:每个词(token)的生成都需要进行一次前向传播,需要访问数十亿至数千亿参数的 LLM。这导致传统自回归解码的速度较慢。

尽管我们无法预料大模型会生成什么,也不知道算力和数据的极限在哪里,但生成式 AI 革命是不可阻挡的。

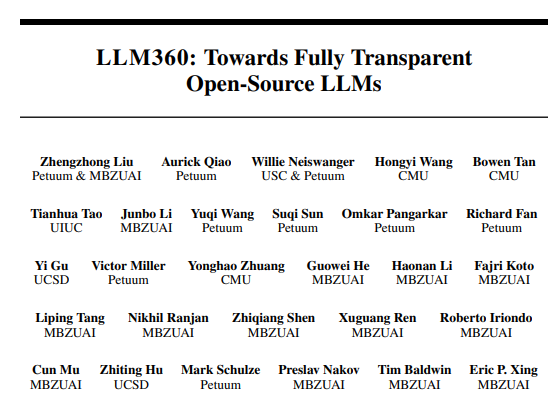

开源模型正展现着它们蓬勃的生命力,不仅数量激增,性能更是愈发优秀。图灵奖获得者 Yann LeCun 也发出了这样的感叹:「开源人工智能模型正走在超越专有模型的路上。

随着大型语言模型(LLM)的发展,从业者面临更多挑战。如何避免 LLM 产生有害回复?如何快速删除训练数据中的版权保护内容?如何减少 LLM 幻觉(hallucinations,即错误事实)? 如何在数据政策更改后快速迭代 LLM?这些问题在人工智能法律和道德的合规要求日益成熟的大趋势下,对于 LLM 的安全可信部署至关重要。

在 AI 取代人类的危机之下,一个程序员的焦虑治愈之路。

UCLA等机构研发的Chameleon框架,在AI界引起广泛关注,获得超过100次学术引用,AlphaSignal评选其为「周最佳论文」。