我谈不过 AI,但 AI 能替我谈 1000 次恋爱

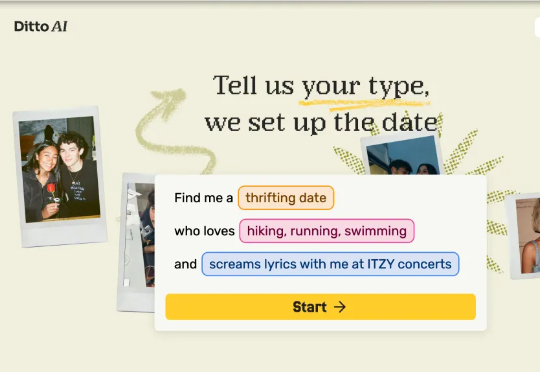

我谈不过 AI,但 AI 能替我谈 1000 次恋爱只管填个资料,AI 就帮你搞定一切:从精准匹配到约会地点的挑选,再到时间安排,甚至还附赠一张定制化「约会海报」。最后,只需要拎包出门,赴一场线下约会。这不再是科幻剧《黑镜》的剧情,而是加州大学伯克利分校两位辍学 00 后学生打造的 Ditto——一款试图用 AI 重塑恋爱方式约会应用。

搜索

搜索

只管填个资料,AI 就帮你搞定一切:从精准匹配到约会地点的挑选,再到时间安排,甚至还附赠一张定制化「约会海报」。最后,只需要拎包出门,赴一场线下约会。这不再是科幻剧《黑镜》的剧情,而是加州大学伯克利分校两位辍学 00 后学生打造的 Ditto——一款试图用 AI 重塑恋爱方式约会应用。

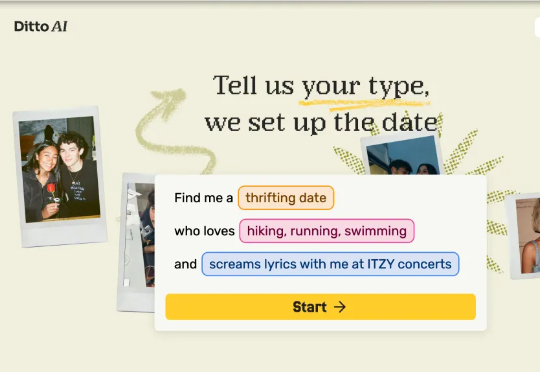

2024年,伯克利人工智能研究中心(BAIR)率先提出了一个新概念——复合人工智能系统(Compound AI Systems,简称CAIS)。这个看似简单的术语背后,蕴含着AI系统架构的根本性改变:不再依赖单一LLM的"超级大脑",而是构建多组件协同的"智能生态系统"。

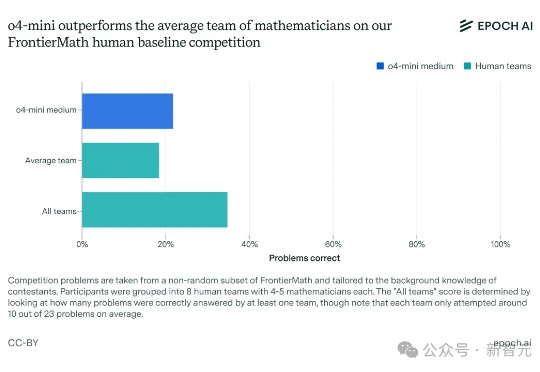

最近,30位世界顶尖数学家亲自出马,在UC伯克利对OpenAI o4-mini展开「围剿」,两天连出教授级难题,结果却当场集体「破防」!有人直言:这个AI,的确已接近数学天才的水平。曾经以为AGI遥遥无期,如今仿佛只剩临门一脚了……

来自华盛顿大学、AI2、UC伯克利研究团队证实,「伪奖励」(Spurious Rewards)也能带来LLM推理能力提升的惊喜。

而马毅是那类觉得不够的人,他于无声处开始提问:智能的本质是什么?自 2000 年从伯克利大学博士毕业以来,马毅先后任职于伊利诺伊大学香槟分校(UIUC)、微软亚研院、上海科技大学、伯克利大学和香港大学,现担任香港大学计算与数据科学学院院长。他和团队提出的压缩感知技术,到现在还在影响计算机视觉中模式识别领域的发展。

仅需5000美元就能实现人形机器人3D打印?UC伯克利这次又又又整新活了!注意看,画面中这个正在认真写名字的小家伙,就是来自UC伯克利的最新作品——人形机器人Berkeley Humanoid Lite (BHL)。

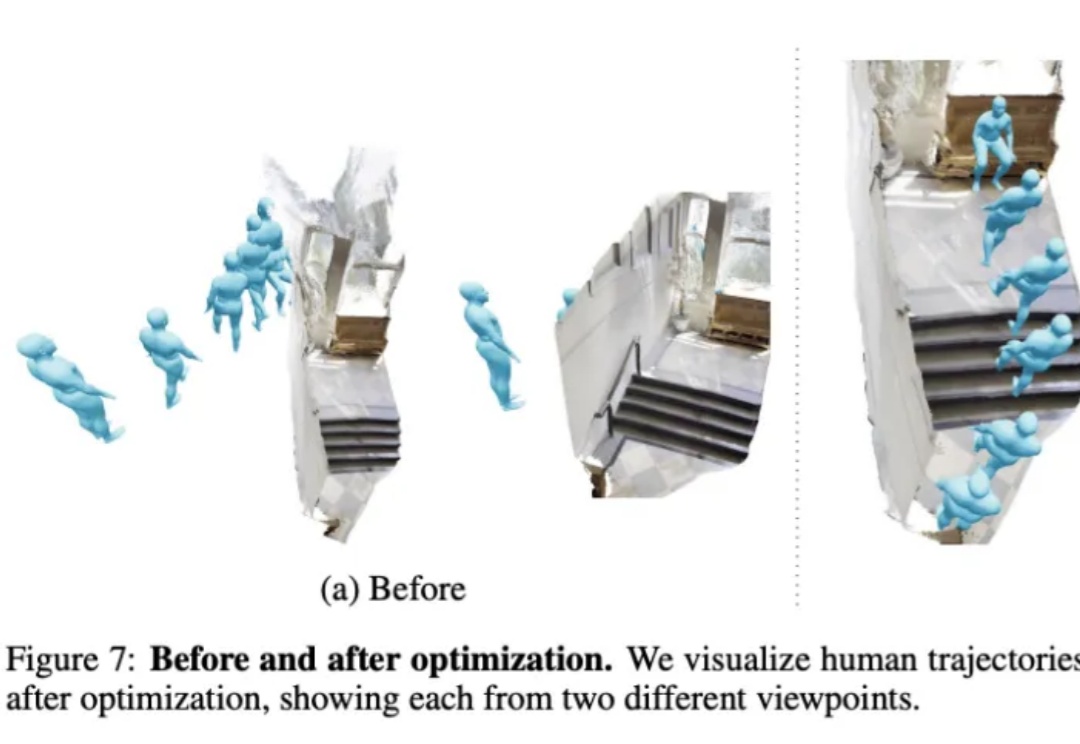

不用动作捕捉,只用一段视频就能教会机器人学会人类动作,效果be like:

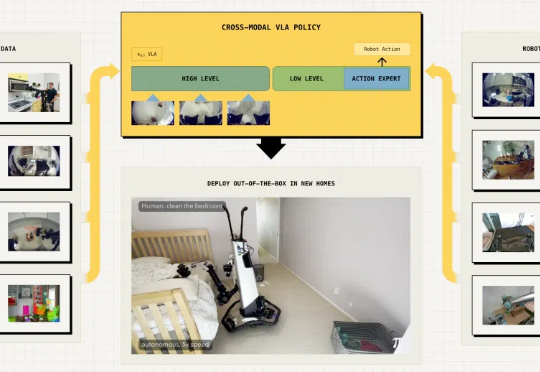

具身智能最大的挑战在于泛化能力,即在陌生环境中正确完成任务。最近,Physical Intelligence推出全新的π0.5 VLA模型,通过异构任务协同训练实现了泛化,各种家务都能拿捏。

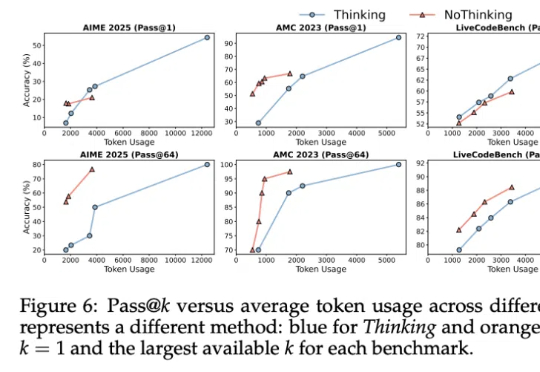

AI也会偷偷努力了?Letta和UC伯克利的研究者提出「睡眠时计算」技术,能让LLM在空闲时间提前思考,大幅提升推理效率。

其实……不用大段大段思考,推理模型也能有效推理!