ICLR 2026 | 中国联通提出扩散模型缓存框架MeanCache,刷新多模态生成模型推理加速新基准

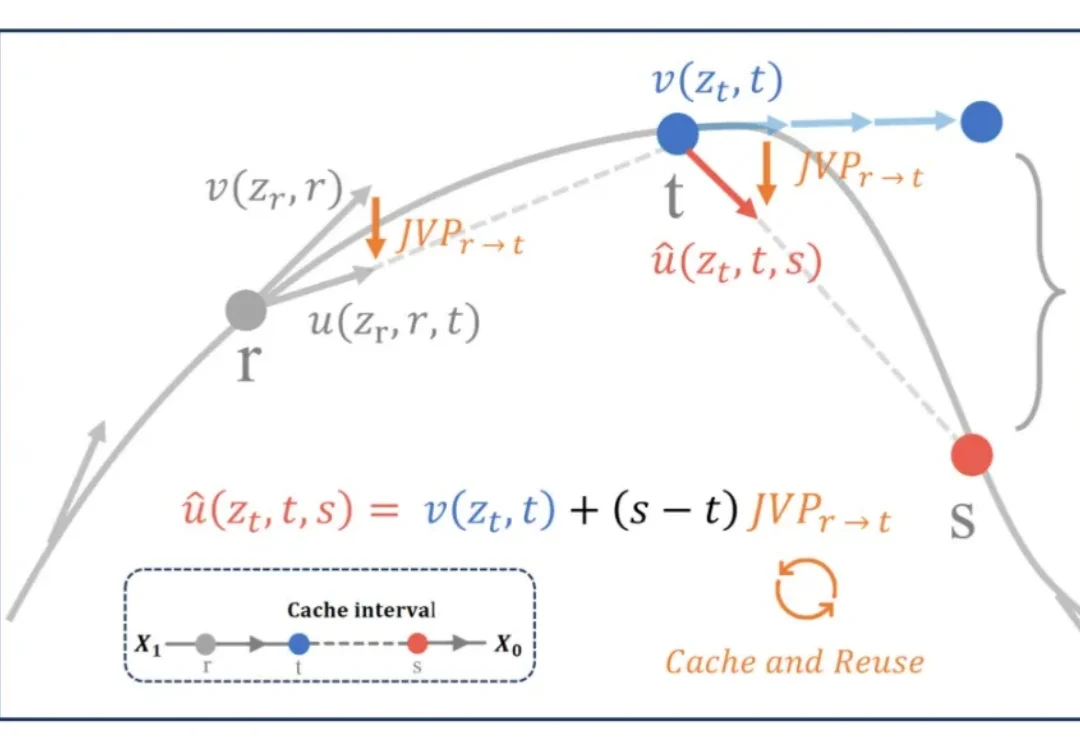

ICLR 2026 | 中国联通提出扩散模型缓存框架MeanCache,刷新多模态生成模型推理加速新基准FLUX 、Qwen-Image 等多模态生成模型的推理速度一直是工业级多模态模型落地的痛点。传统的特征缓存(Feature Caching)方案在追求高倍率加速时,常因瞬时速度的剧烈波动导致轨迹漂移。

FLUX 、Qwen-Image 等多模态生成模型的推理速度一直是工业级多模态模型落地的痛点。传统的特征缓存(Feature Caching)方案在追求高倍率加速时,常因瞬时速度的剧烈波动导致轨迹漂移。

昨晚,Anthropic 意外在一个 npm 包更新中泄漏了其核心产品 Claude Code 高达 51.2 万行的底层源代码,参阅《全网疯传fork!刚刚,Claude Code源代码泄露被开源了》。此事过去还不到一天,刚刚,Anthropic 的主要竞争对手 OpenAI 官方宣布已完成最新一轮融资,本轮获取承诺资本达 1220 亿美元,投后估值飙升至 8520 亿美元!

Peter Deng 八年做了一个消费投资。一个。

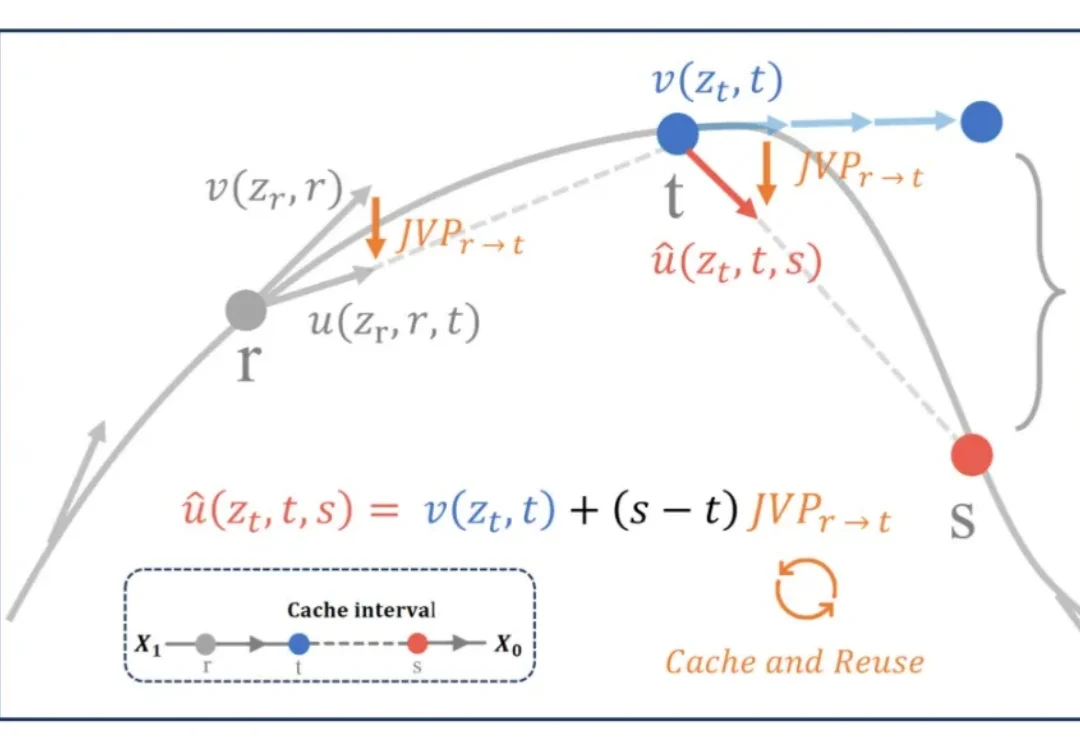

长上下文推理已经成了VLM/LLM的默认形态。

近期,大厂的AI实验室正迎来一场深度结构性调整。

对于 Anthropic 而言,这是继前几天 Mythos 模型文档外泄后的又一次严重 OpSec事故。但对于整个大模型应用层的开发者和行业研究者来说,这份源码却是一份毫无保留的、价值极高的前沿 AI Agent 工程架构白皮书。

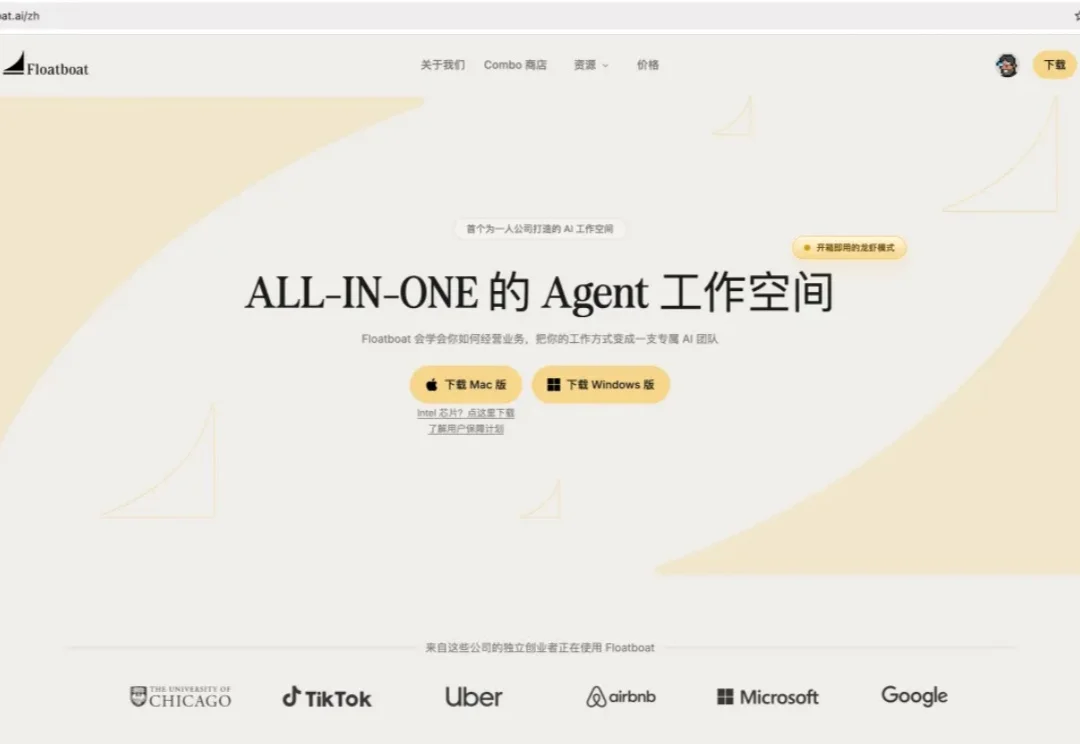

前段时间 APPSO 在中关村的一场线下聚会看到了一个还在测试中的 AI 办公产品——它很大程度上摒弃了对「前摇」的依赖。产品名字叫 Floatboat。

从拦截彼得·蒂尔、警告马斯克,到如今公开说「必须有适应能力」,哈萨比斯史诗级转身:AI安全窗口正在永久关闭,他不再幻想制度,而是赌上全部身家——赌影响力,赌良知,赌自己。

这轮AI,为什么逼着企业家重新回到一线。

AI 论文之争,本质是话语权之争。