图神经网络加持,突破传统推荐系统局限!北大港大联合提出SelfGNN:有效降低信息过载与数据噪声影响

图神经网络加持,突破传统推荐系统局限!北大港大联合提出SelfGNN:有效降低信息过载与数据噪声影响SelfGNN框架结合了图神经网络和个性化自增强学习,能够捕捉用户行为的多时间尺度模式,降低噪声影响,提升推荐系统鲁棒性。

SelfGNN框架结合了图神经网络和个性化自增强学习,能够捕捉用户行为的多时间尺度模式,降低噪声影响,提升推荐系统鲁棒性。

亚历山大·王从麻省理工学院辍学后开始创业,25岁被《福布斯》评为“世界上最年轻的白手起家的亿万美元富翁”。

6月,IEEE刊登了一篇对ChatGPT代码生成任务进行系统评估的论文,数据集就是程序员们最爱的LeetCode题库。研究揭示了LLM在代码任务中出现的潜在问题和能力局限,让我们能够对模型做出进一步改进,并逐渐了解使用ChatGPT写代码的最佳姿势。

市值140亿美元的初创公司Scale AI正在招聘博士训练LLM,用人成本的升高让该公司的毛利率在2023年有所下降,但创始人Alexandr Wang预计今年营收将增加两倍,突破十亿美元。

大模型产业发展,需要可信中立的数据深加工平台,如何填补空白?

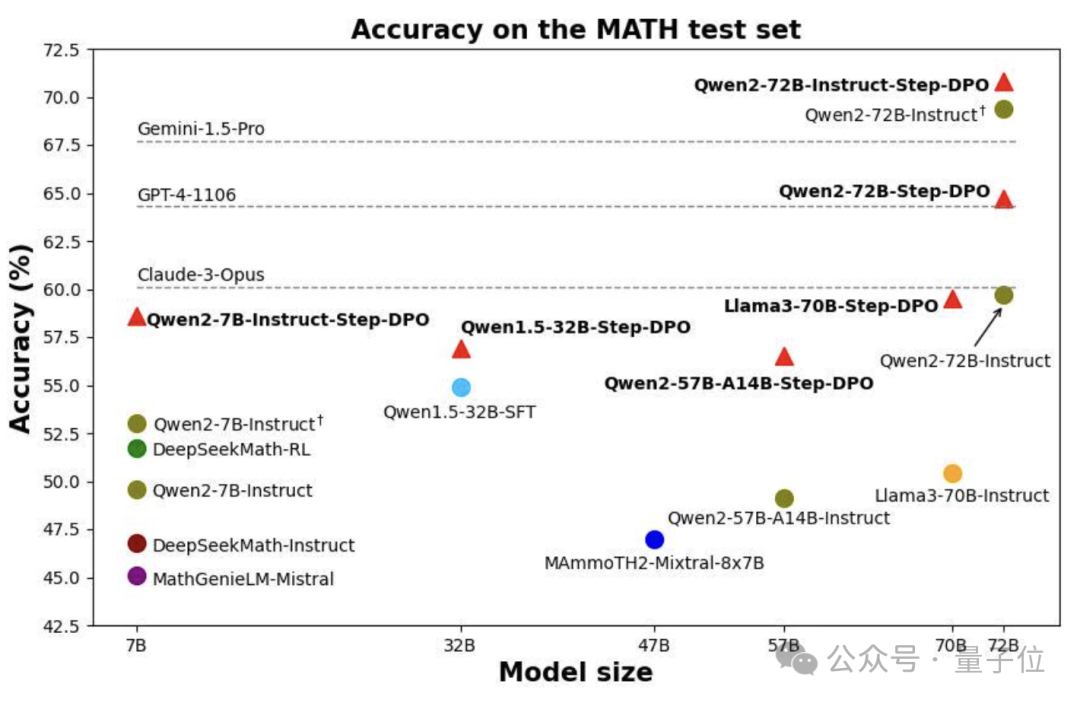

只要10k数据,就能让大模型的数学成绩增长5.6%。

最近,一个对标 GPT-4o 的开源实时语音多模态模型火了。

有多少智能,就有多少人工

在信息爆炸的时代,随着个人存储需求的激增和变化,以及个体对数据隐私和安全性的日益重视,外加AI的技术加持,一种大家也许并不熟知的存储解决方案——NAS迎来了发展机遇。

马斯克连回两条推文为xAI造势,宣布8月发布Grok 2,年底将推出在10万张H100上训练的Grok 3,芯片加持创新数据训练,打造对标GPT的新一代大语言模型。