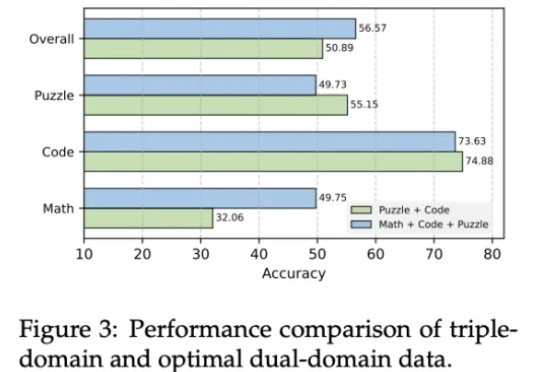

混合数学编程逻辑数据,一次性提升AI多领域强化学习能力 | 上海AI Lab

混合数学编程逻辑数据,一次性提升AI多领域强化学习能力 | 上海AI Lab近年来,AI大模型在数学计算、逻辑推理和代码生成领域的推理能力取得了显著突破。特别是DeepSeek-R1等先进模型的出现,可验证强化学习(RLVR)技术展现出强大的性能提升潜力。

近年来,AI大模型在数学计算、逻辑推理和代码生成领域的推理能力取得了显著突破。特别是DeepSeek-R1等先进模型的出现,可验证强化学习(RLVR)技术展现出强大的性能提升潜力。

思维链 (CoT) 提示技术常被认为是让大模型分步思考的关键手段,通过在输入中加入「Let’s think step by step」等提示,模型会生成类似人类的中间推理步骤,显著提升复杂任务的表现。然而,这些流畅的推理链条是否真的反映了模型的推理能力?

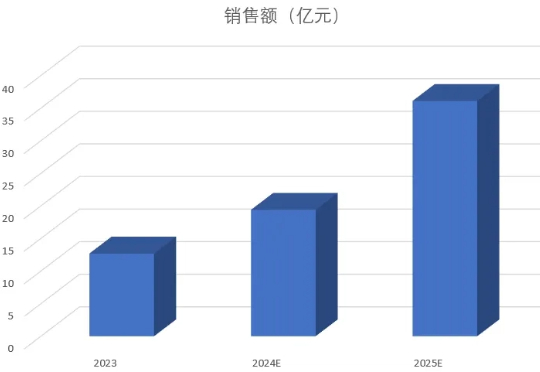

在生成式 AI 时代,全球数据总量正以惊人速度增长,据 IDC 预测,2025 年将突破 180ZB,其中 80% 为非结构化内容,传统数据分析在应对多模态信息和打破结构化数据技术壁垒方面尽显乏力,“人工找数 + 手动分析” 的模式严重抑制甚至沉没了数据价值。

Figure人形机器人首秀,靠神经网络叠衣服! 在没有任何架构改变、仅增加了数据的情况下,就让原本在物流场景干活的它,轻松习得了新技能。

“我真的厌倦了看到那些急于求成的科技初创公司,为了讨好风投而在数据上撒谎,还贴上‘SOTA’的标签。”有网友吐槽。 事情源于高人气开源智能体记忆项目 Mem0 在今年 4 月底发布的一篇论文。

过去几年,AI 的巨大突破赋予了机器语言的力量。而下一个前沿,是给予它们关于世界的记忆。当大模型只能分析短暂的视频内容时,一个根本性的鸿沟依然存在:AI 能够处理信息,却无法真正地“记住” 信息。如今的瓶颈已不再是“看见”,而是如何保留、索引并回忆构成我们现实世界的视觉数据流。

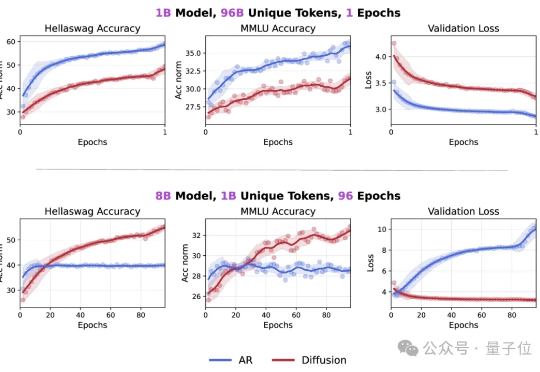

Token危机真的要解除了吗? 最新研究发现,在token数量受限的情况下,扩散语言模型的数据潜力可达自回归模型的三倍多。

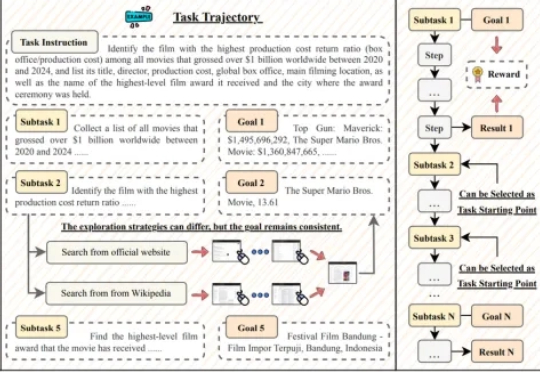

年初,DeepSeek 前脚带来模型在推理能力上的大幅提升,Manus 后脚就在全球范围内描绘了一幅通用 Agent 的蓝图。新的范本里,Agent 不再止步于答疑解惑的「镶边」角色,开始变得主动,拆解分析需求、调用工具、执行任务,最终解决问题……

一面是Meta豪掷143亿美元下注Scale AI,一面是OpenAI紧急切断合作——当全球目光聚焦硅谷之时,一家藏身首尔的初创公司悄然撕开了AI安全市场的裂口。

GUI 智能体正以前所未有的速度崛起,有望彻底改变人机交互的方式。然而,这一领域的进展正面临瓶颈:现有数据集大多聚焦于 10 步以内的短程交互,且仅验证最终结果,无法有效评估和训练智能体在真实世界中的长时程规划与执行能力。