CVPR 2026|DROID-W:复杂室外动态场景,也能稳定SLAM

CVPR 2026|DROID-W:复杂室外动态场景,也能稳定SLAMSLAM 在自动驾驶、机器人、AR/VR 乃至具身智能系统中都是至关重要的环节,它决定了算法能否在一个陌生环境中一边“看懂世界”,一边“知道自己在哪”。

搜索

搜索

SLAM 在自动驾驶、机器人、AR/VR 乃至具身智能系统中都是至关重要的环节,它决定了算法能否在一个陌生环境中一边“看懂世界”,一边“知道自己在哪”。

就在刚刚,MIT伯克利斯坦福的研究者给出数学铁证:ChatGPT正诱发「AI精神病」!哪怕你是理想的贝叶斯理性人,也难逃算法设下的「妄想螺旋」。

两个备案概念都涉及"AI",为啥就是不一样? 合规路径+完整流程+避坑清单,看完就懂!

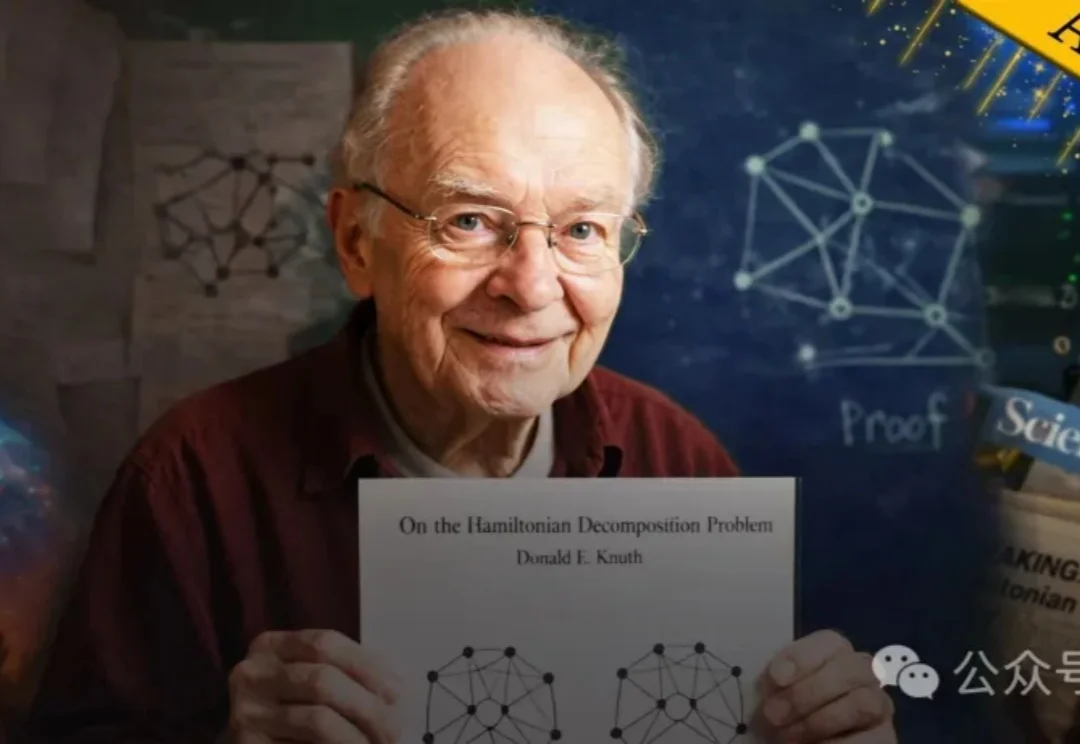

「哈密顿分解」难题,终于破解!88岁「算法祖师爷」高德纳再更论文,Claude 4.6+GPT-5.4联合破解了奇偶数情形。甚至,GPT-5.4直出一篇14页论文,引爆全网。

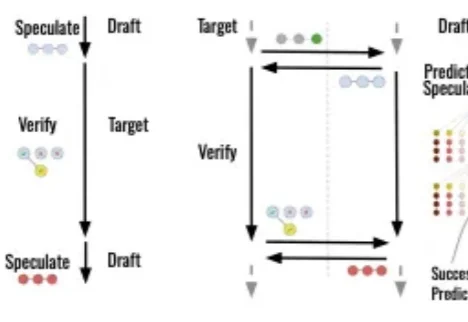

在大语言模型推理领域,虽然「推测解码」(Speculative Decoding,SD)已成为加速生成的标准配置,但它依然存在一个致命弱点: drafting(草拟)和 verification(验证)之间必须串行进行。

三月的Claude,不是在崩,就是在去崩的路上。状态页48条incident、major/critical事故窗口累计超44小时——这还是保守算法。更离谱的是,$200/月的Max顶配用户反映一小时不到就被限流,项目做到一半突然断供,零预警。推特上「60秒退订教程」疯传,开发者成群结队涌向Codex+GPT 5.4。但逃到对岸就安全了吗?OpenAI状态页显示:Codex三月也崩了7个小时。

这家新西兰的公司给奶牛戴上AI项圈,估值一年飙升20亿美元!Founders Fund领投,投资人抢到超额认购。它的秘密武器叫「Cowgorithm」——一套让牛自己放自己的算法。

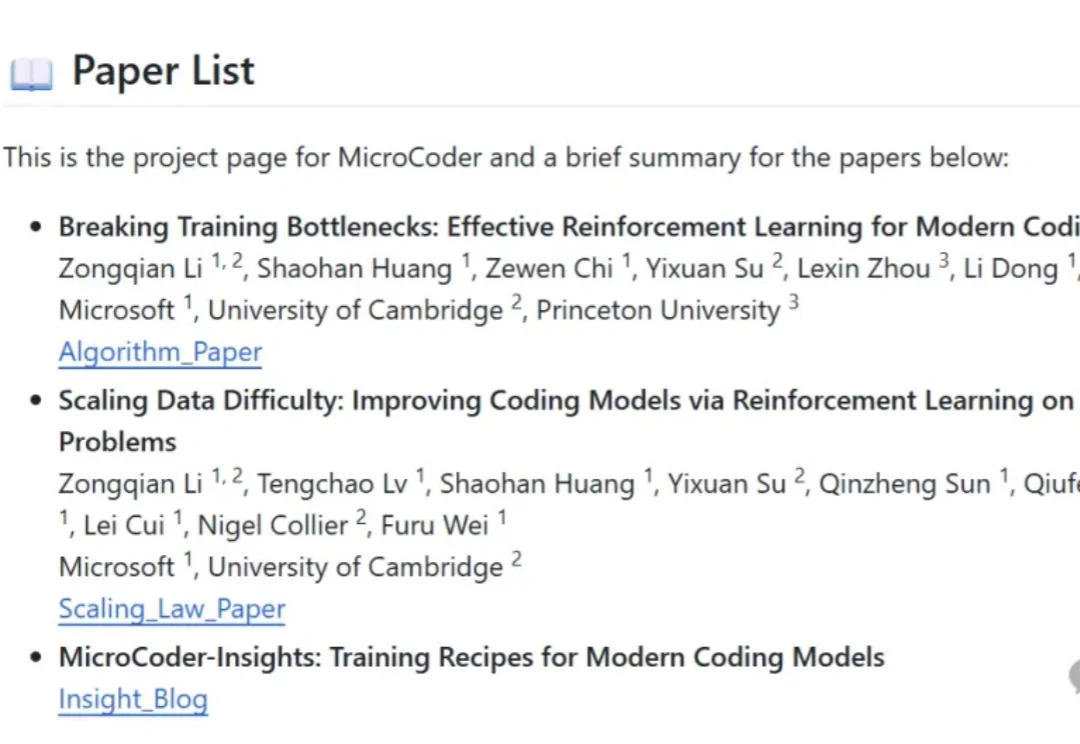

新一代代码模型的训练动态已与旧模型截然不同,主流强化学习方法和数据集在其上几乎“失效”。

前几天,Google Research 在 X 平台正式发布了名为 TurboQuant 的 AI 压缩算法,24 小时内浏览量破千万。但就在刚刚,苏黎世联邦理工学院博士后高健扬在知乎发出一封公开澄清信。他是论文里被比较算法 RaBitQ 的第一作者,指出 TurboQuant 存在三处严重问题:

看过 HBO 神剧《硅谷》(Silicon Valley)的朋友,想必都对那个名为 Pied Piper(魔笛手)的虚构公司念念不忘。