如何将 LLM 的上下文扩展至百万级?

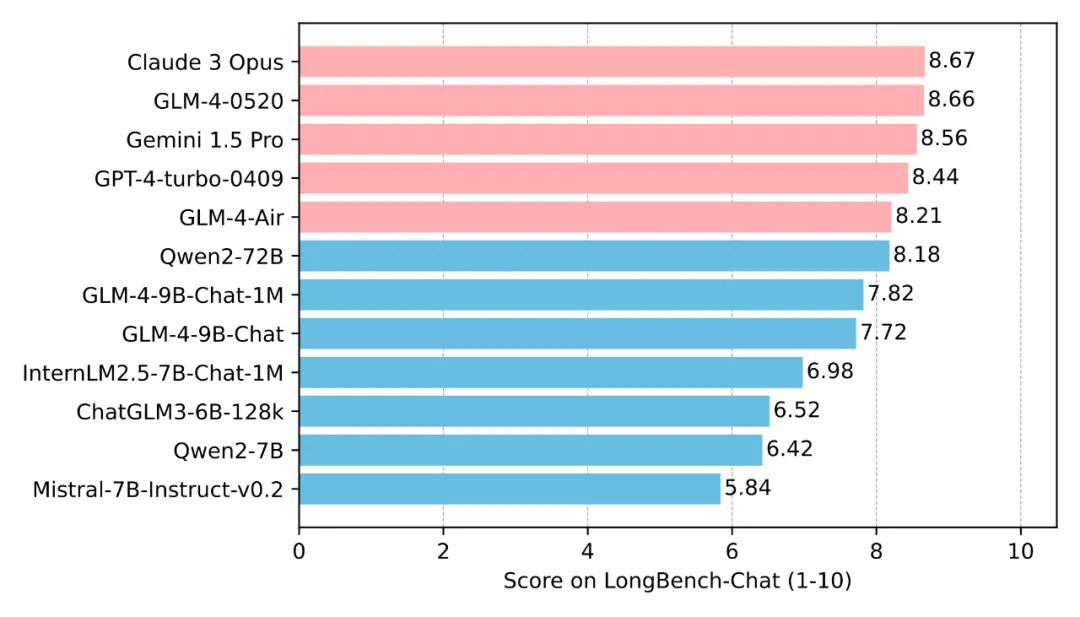

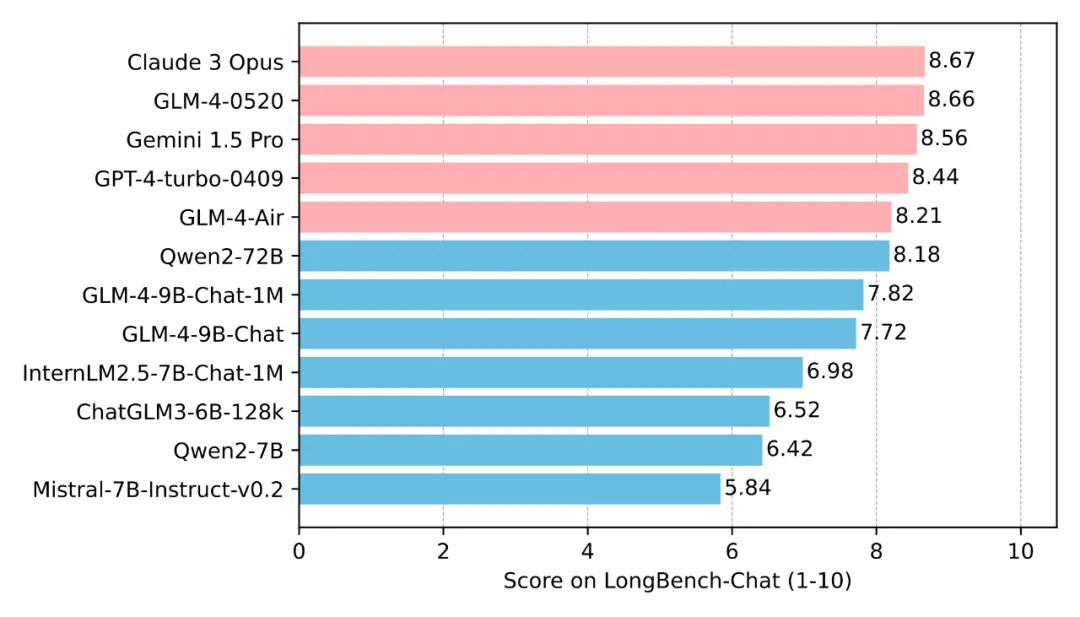

如何将 LLM 的上下文扩展至百万级?在2023年初,即便是当时最先进的GPT-3.5,其上下文长度也仅限于2k。然而,时至今日,1M的上下文长度已经成为衡量模型技术先进性的重要标志之一。

在2023年初,即便是当时最先进的GPT-3.5,其上下文长度也仅限于2k。然而,时至今日,1M的上下文长度已经成为衡量模型技术先进性的重要标志之一。

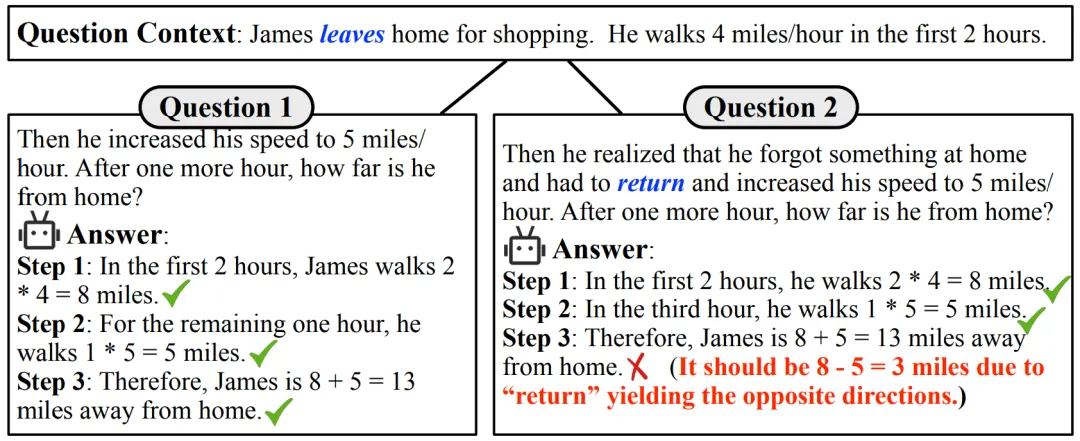

大型语言模型(LLMs)在解决问题方面的非凡能力日益显现。最近,一个值得关注的现象是,这些模型在多项数学推理的基准测试中获得了惊人的成绩。以 GPT-4 为例,在高难度小学应用题测试集 GSM8K [1] 中表现优异,准确率高达 90% 以上。同时,许多开源模型也展现出了不俗的实力,准确率超过 80%。

离开快手创业后,「李岩」悄悄拿到了快手联合创始人宿华、红点创投以及经纬创投的3200万美金种子轮融资。

只需激活60%的参数,就能实现与全激活稠密模型相当的性能。

「AI教母」创业,3个月就干出了估值10亿的AI独角兽。

创业夫妻店雇AI做设计,显示器爆单成行业品牌No.1。这背后,不仅是3亿用户出海业务给的底气,也是因为一个团队一心做好了3件事。

World Labs被曝已完成2轮融资,最新一轮融资金额约1亿美元。

AI 视频生成公司 HeyGen 最近完成了 6000 万美元的 A 轮融资,公司估值已达 5 亿美元。此次融资由 Benchmark 领投,Conviction、Thrive Capital 和 Bond Capital 参与。截至目前,HeyGen 已累计筹到 7400 万美元。

艾瑞推算2023年中国AI基础数据服务市场规模为45亿元。

自回归解码已经成为了大语言模型(LLMs)的事实标准,大语言模型每次前向计算需要访问它全部的参数,但只能得到一个token,导致其生成昂贵且缓慢。