Z Tech|一个词就能视觉推理?Meta 华人颠覆性提出 ATLAS 新范式

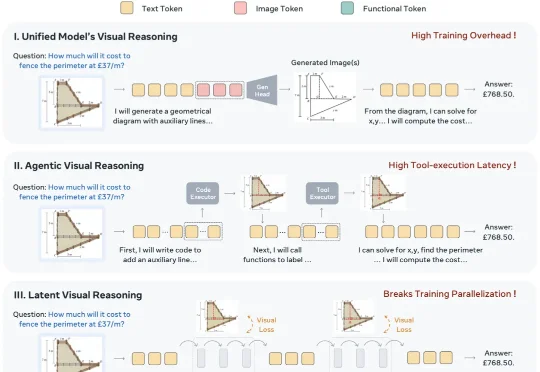

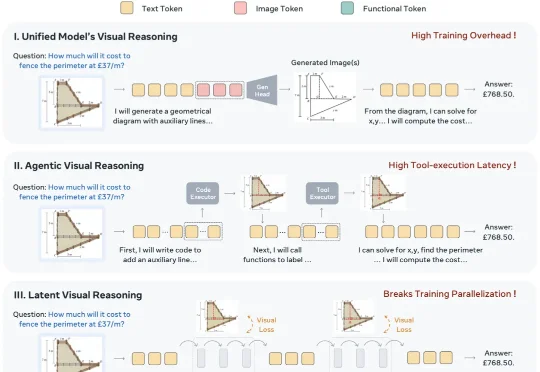

Z Tech|一个词就能视觉推理?Meta 华人颠覆性提出 ATLAS 新范式近日,Meta AI 与香港中文大学颠覆性提出了一种全新的视觉推理范式 ATLAS,不用外部工具,不显式生成中间图像,没有视觉监督信号,只用一个离散 word,首次颠覆性地代替 Agentic 和 Latent Visual Reasoning。

搜索

搜索

近日,Meta AI 与香港中文大学颠覆性提出了一种全新的视觉推理范式 ATLAS,不用外部工具,不显式生成中间图像,没有视觉监督信号,只用一个离散 word,首次颠覆性地代替 Agentic 和 Latent Visual Reasoning。

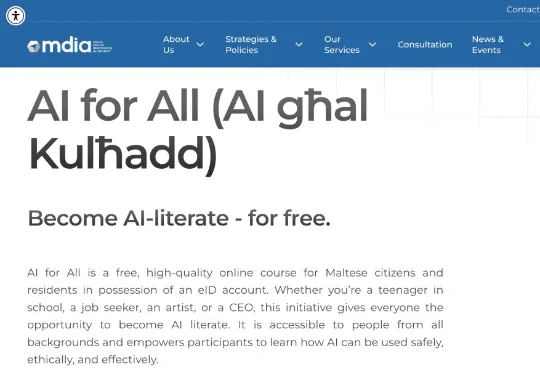

马耳他政府刚刚消息:向全体国民提供免费的 AI 课程,以及免费的 ChatGPT Plus 会员。马耳他成为首个把 AI 作为全民基础服务来发放的国家。项目名叫 AI for All(马耳他语 AI għal Kulħadd),意思是“全民 AI”。第一阶段五月启动,由马耳他数字创新管理局负责分发

2022年10月,Elon Musk 以 440 亿美元收购 Twitter,第一件事就是解雇 CEO Parag Agrawal。这位被 Jack Dorsey 亲自提拔的印度裔工程师,在舆论场里几

面向一系列智能体时代的技术挑战和行业矛盾,联发科的思路和角色定位都非常明确:做好“赋能者”。终端层,联发科有着全场景芯片矩阵,这些芯片可以在各类智能终端中落地,成为智能体时代的AI算力底座。

在过去很长的一段时间里,英伟达都被迫只能站在中间,一边是美国出口管制,一边是中国市场需求,老黄当然想找到一个突破口。也就是在同一天晚上,Anthropic发了一篇很不寻常的文章。文章标题叫《2028:Two scenarios for global AI leadership》,讲的是2028年全球AI领导权的两种可能。

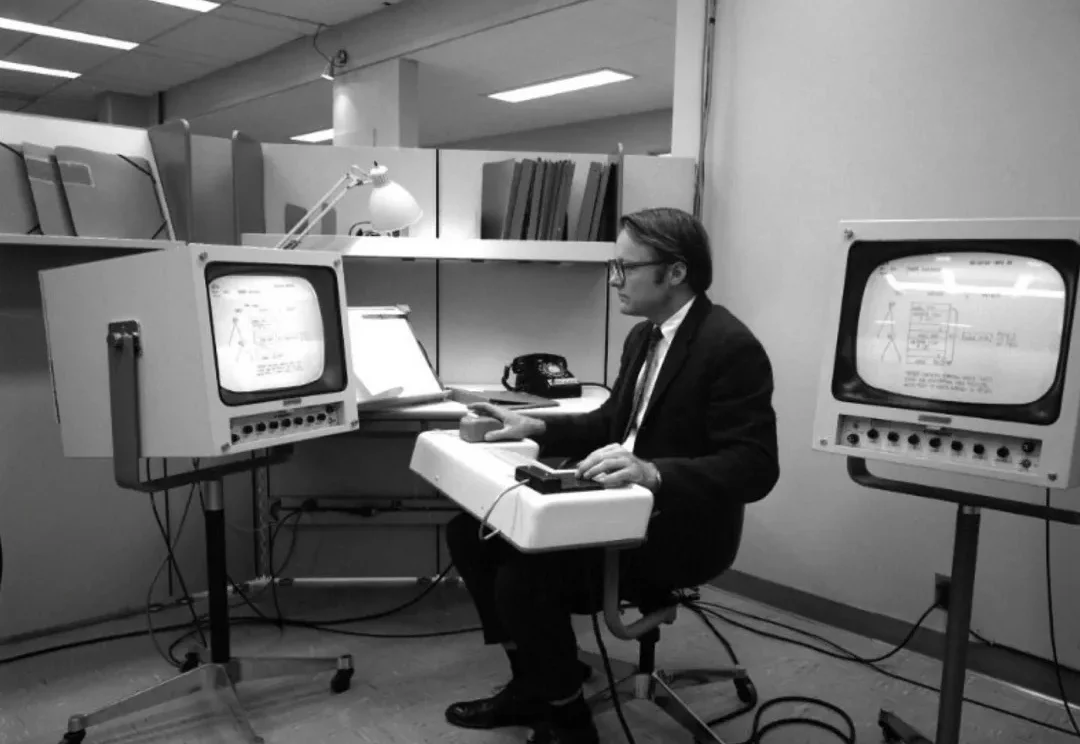

1968 年的旧金山,计算机科学家道格拉斯·恩格尔巴特在一场后来被称为「演示之母(The Mother of All Demos)」的发布会上,拿出一个带着两个金属轮子的木制小盒子,向世界介绍了一个新物种:鼠标。

加入Meta近一年——也被争议了快一年,亚历山大王(Alexander Wang)首次出来公开回应一切!

Z Potentials独家获悉,清华系具身智能公司灵御智能宣布完成天使+轮近亿元人民币融资。本轮融资距离上次融资仅有两个月,由福田资本领投,力合创投、金沙江联合资本、复利多、楹辉创投、华仓资本跟投,老股东英诺基金、天鹰资本持续加注。Maple Pledge枫承资本长期出任公司私募股权融资顾问。

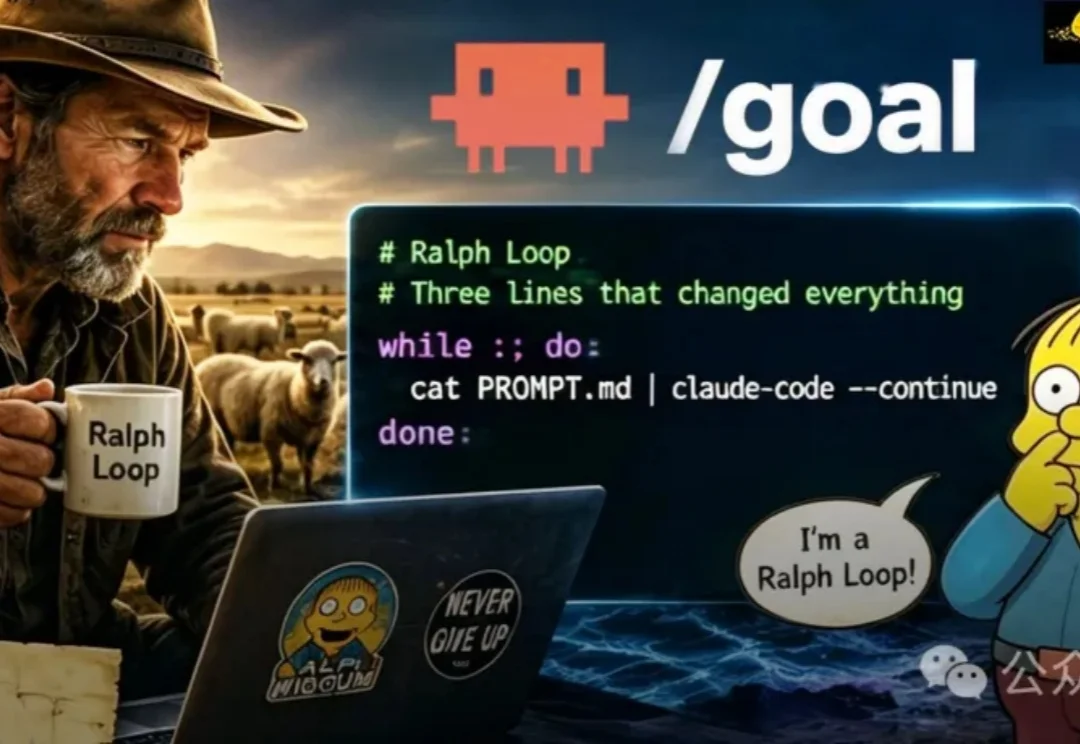

澳洲牧羊大叔随手写的三行bash,11天内被OpenAI、Anthropic和Hermes集体收编了。

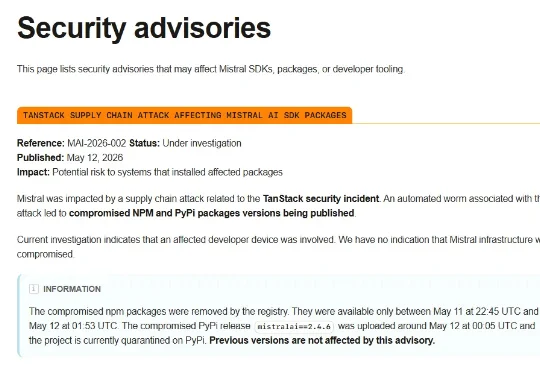

刚刚,Hermes Agent 确认被投毒了!白天摸鱼的时候,发现有人说 Hermes Agent 依赖的一个 PyPI 包 mistralai 可能被投毒了。虽然不是 Hermes Agent 本体出问题了,但这事影响一点都不小。