怎么看 Anthropic 进军金融

怎么看 Anthropic 进军金融上周,Anthropic 一口气做了三件事。 单看任何一件,都可以说是"正常的商业合作"。但 Reid Hoffman——LinkedIn 联合创始人,投过 OpenAI 的早期,现在是 Micros

搜索

搜索

上周,Anthropic 一口气做了三件事。 单看任何一件,都可以说是"正常的商业合作"。但 Reid Hoffman——LinkedIn 联合创始人,投过 OpenAI 的早期,现在是 Micros

今天一早,我去了北京国家会议中心,参加百度Create 2026 AI开发者大会-超级个体主论坛。

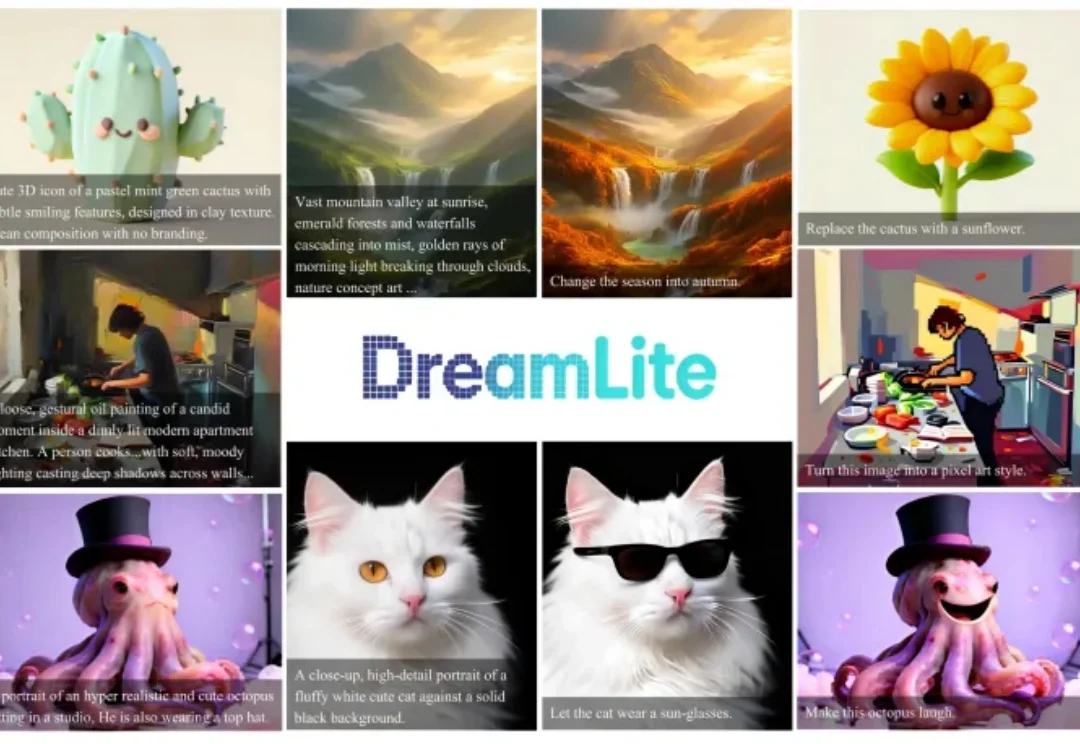

近日,字节跳动智能创作部门(Intelligent Creation Lab)提出新作 DreamLite,一个主干网络仅有 0.39B 参数的轻量级统一扩散模型,在单一网络内同时支持文生图(Text-to-Image) 和图像编辑(Text-guided Image Editing)两个任务,是目前已知首个实现这一能力的端侧模型。

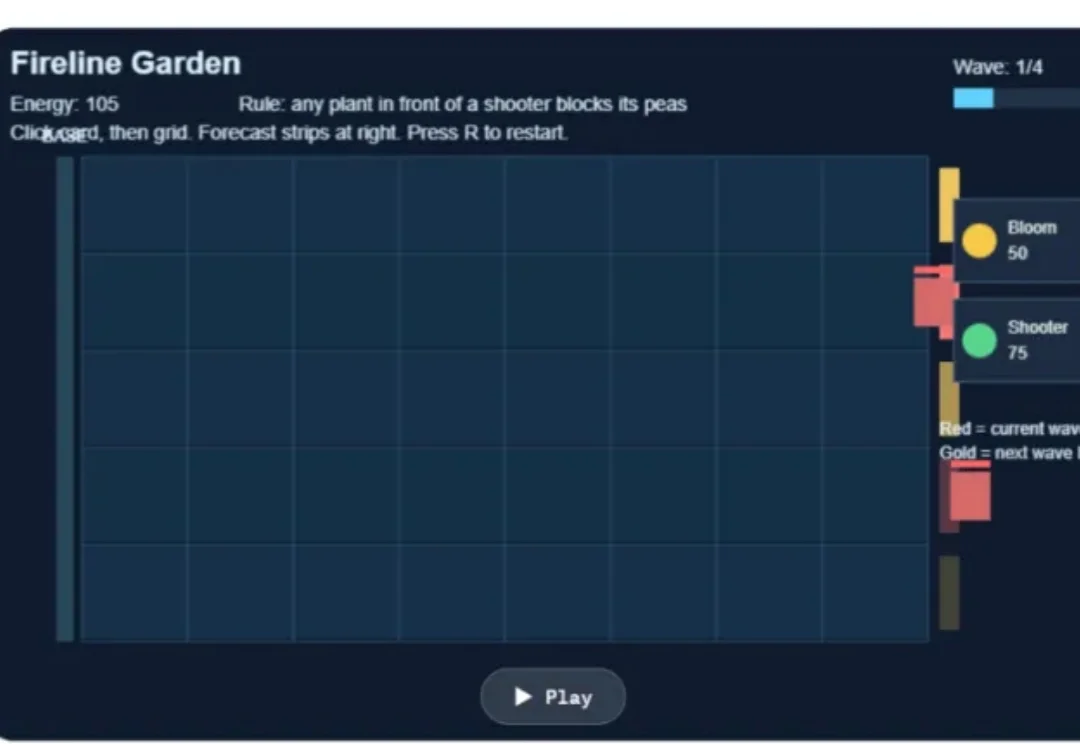

让大模型写一个小游戏,已经不新鲜了。它可以很快生成一个 Flappy Bird、一个塔防游戏、一个物理解谜页面,甚至还能补上按钮、分数和简单动画。但真正的问题是:这些游戏到底有没有新的玩法?它们是在创造,亦或只是把已有游戏换了一层皮?

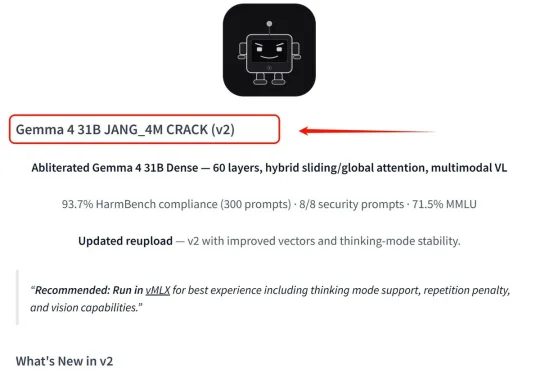

有个31B参数的大模型,正常需要80GB显存才能跑。但现在,24GB显存就能跑满血版。这个版本叫Gemma-4-31B-JANG_4M-CRACK——"CRACK"这个词不要理解歪了,它本质是量化压缩加上对齐微调之后的部署版本,不是什么黑客攻击,就是工程优化。24GB,MacBook Pro,直接跑。苹果用户优先优化,MLX原生支持,月下载13000次。

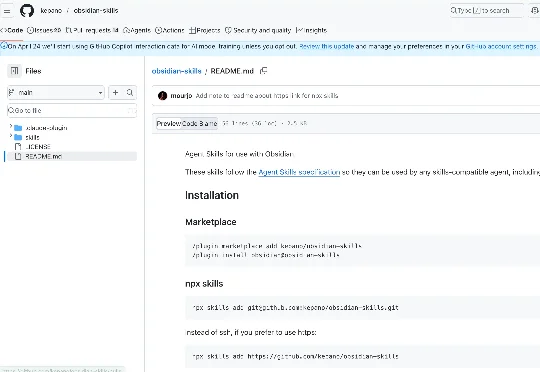

随手打开 GitHub,2026 年的 Agent 项目热榜上有这样一个仓库: • 27,000+ stars,1,800+ forks • 零行 Python,零行 TypeScript,零行 JS • 作者是 Obsidian 的 CEO 本人,kepano • 整个仓库就是 5 个 Markdown 文件

4 月 9 日,Anthropic 在 X 上宣布 Claude Managed Agents 上线。同一天,一位 ID 叫 @jiayuan_jy 的中国创业者也发了一条推,“We created the open source version of Claude Managed Agents. Introducing Multica.”

先说说什么是小孩 AI?说实话,我之前还真没怎么关注过。大致指的是:五年级搞智能驾驶,11 岁复刻 Minecraft,15 岁做 AI 创业公司雇了一个 38 岁员工,小学生 AI 编程速成营,AI 启蒙、AI 启智、AI 启辰,「不学编程的小孩会被 AI 时代淘汰」。

两天前,Creati AI推出了新产品Buzzy。Buzzy是一个专门做视频修改的AI Agent。用户可以对视频说“把这个人换成我的脸”“把阴天变成黄昏”“去掉背景里的路人”,局部修改,其他不动。几乎同时,公司官宣了由红点领投的B轮融资,金额高达2000万美元。

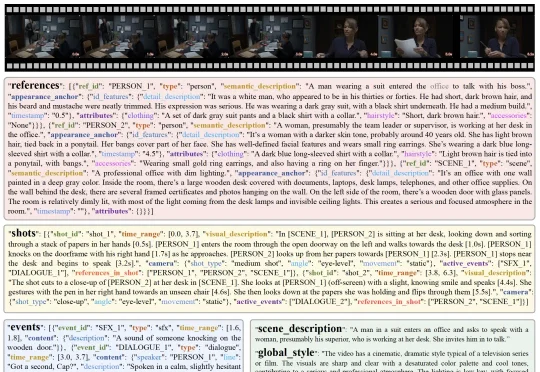

腾讯混元团队提出了 Multi-Stream Scene Script(MTSS),一种全新的视频描述范式 —— 将传统的 "一段话描述整个视频" 升级为 "多流结构化剧本",通过 Stream Factorization 和 Relational Grounding 两大核心原则,让视频描述既忠实又可扩展,在视频理解和生成任务中均取得显著提升。