a16z投了一家“不看简历”的AI招聘公司

a16z投了一家“不看简历”的AI招聘公司5月6日,主营AI招聘的初创公司Ethos宣布完成2275万美元(约合人民币1.55亿元)的A轮融资,由a16z领投,General Catalyst、XTX Markets、Evantic Capital和Common Magic跟投。

搜索

搜索

5月6日,主营AI招聘的初创公司Ethos宣布完成2275万美元(约合人民币1.55亿元)的A轮融资,由a16z领投,General Catalyst、XTX Markets、Evantic Capital和Common Magic跟投。

两位哈佛毕业的女生 Eva Tuecke 和 Catherine Yeo 用 AI 改变了电池故障排查,她们创立的 Altara 公司在近日获得 700 万美元种子轮融资,估值 7 亿美元,领投方是 Greylock。Neo、BoxGroup 和 Liquid 2 Ventures 也参与了本轮融资,此外还有包括 Jeff Dean 在内的知名天使投资人以及 OpenAI 和 AMD 的高层领导。

2026年5月4日,testingcatalog在Anthropic的Web/Mobile客户端里挖出隐藏功能Orbit。5月6日,Code with Claude大会在旧金山开幕。Orbit不等你开口就从Gmail、Slack、GitHub里替你干活了。

一边是 DeepSeek。2026 年 4 月 24 日,正式发布新一代模型DeepSeek-V4 系列预览版,并同步开源。另一边,美团闷声干了件大事——用全国产算力集群,训练出了万亿参数大模型 LongCat-2.0 系列预览版( LongCat-2.0-Preview )。

SentiPulse(思维光谱)公测了一款叫 SentiCat 的产品,把这套理念落了地。一个有 Live2D 形象、有性格的数字角色 SUSU,负责陪你聊天、了解你、跟你建立关系;她的“AI 小猫”,负责写 PPT、查资料、改代码,脏活累活归它。

能陪聊,能干活,还能提供情绪价值。这个抱着AI小猫的女孩叫SUSU,她们都来自AI初创公司SentiPulse思维光谱自主研发的AI Agent产品——SentiCat。SentiCat拥有三大核心能力:办公自动化、深度研究、代码开发。不管是写报告、做PPT,还是帮你写代码、找bug,都不在话下。

相似度超越Seed-TTS、MiniMax-Speech等知名模型。昨晚,美团LongCat团队发布了文本转语音模型LongCat-AudioDiT,并开源1B、3.5B参数量的版本。这一模型的最大特点,是彻底抛弃了梅尔谱等中间表示,直接在波形潜空间进行基于扩散模型的文本转语音。通俗地说,这一模型直接根据声音本身的规律进行生成,“雕刻”出最原始的声音波形,从根源阻断数据转换的级联误差。

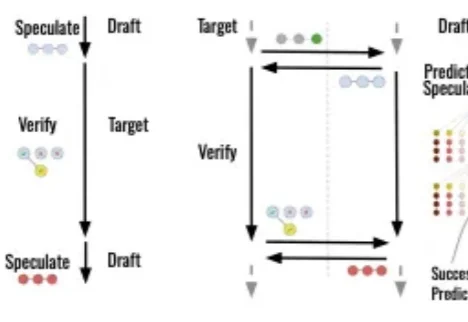

在大语言模型推理领域,虽然「推测解码」(Speculative Decoding,SD)已成为加速生成的标准配置,但它依然存在一个致命弱点: drafting(草拟)和 verification(验证)之间必须串行进行。

Mirage(原 Captions)宣布获得 7500 万美元 融资,由 General Catalyst 旗下 Customer Value Fund(CVF)提供。这类资金的逻辑,与传统 VC 明显不同,它更关注已经被验证的增长模型与单位经济,而不是单纯押注未来。

视频编辑应用 Captions 的开发商 Mirage 已从 General Catalyst 的客户价值基金(CVF)筹集了 7500 万美元的增长融资。