149 元叫了个保洁,来了三个人伺候一台机器人,超值

149 元叫了个保洁,来了三个人伺候一台机器人,超值花 149 块钱,能买到什么级别的保洁服务?答:一个阿姨 + 一个工程师 + 一台重逾百公斤的盘式机器人,上门服务三小时。这个配置放在 58 到家的订单页上,一度让人怀疑是不是系统 Bug,少了打了一个零?

搜索

搜索

花 149 块钱,能买到什么级别的保洁服务?答:一个阿姨 + 一个工程师 + 一台重逾百公斤的盘式机器人,上门服务三小时。这个配置放在 58 到家的订单页上,一度让人怀疑是不是系统 Bug,少了打了一个零?

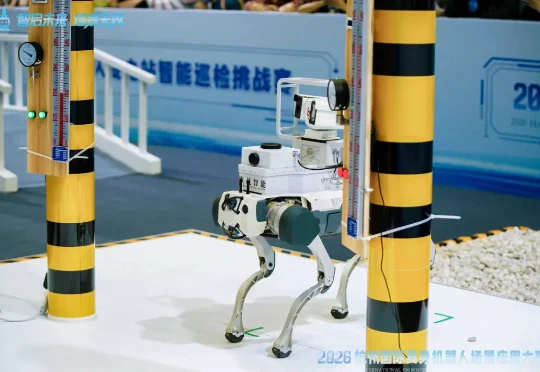

5 月 15 日,杭州西湖云栖小镇。经过前两天雨水的洗礼,春末夏初的空气里透着清新,风也温柔。但小镇里的各大机器人,可顾不上「感受」这份惬意…… 一台四足机器人小心翼翼踩过碎石路,踉跄两步稳住身体,继续执行变电站智能巡检任务;几米外,另一台四足机器人穿过倒塌的废墟,一头钻进模拟浓烟中,展开搜救工作。

独家获悉,深度机智成立一周年完成多轮融资,累计融资总额数亿元。资方包括中关村资本、普华资本、东方富海、蓝湖资本、晶科能源控股旗下CVC基金、诚通科创基金、云岫资本、未来光锥前沿科技基金、北京熙诚致远等,同时获得中科大校友基金支持。

美国具身卷到飞起,明星企业Figure再整新活: 这一次,他们让机器人进厂打工,8小时不间断直播放送。

原力灵机释放商业化信号。

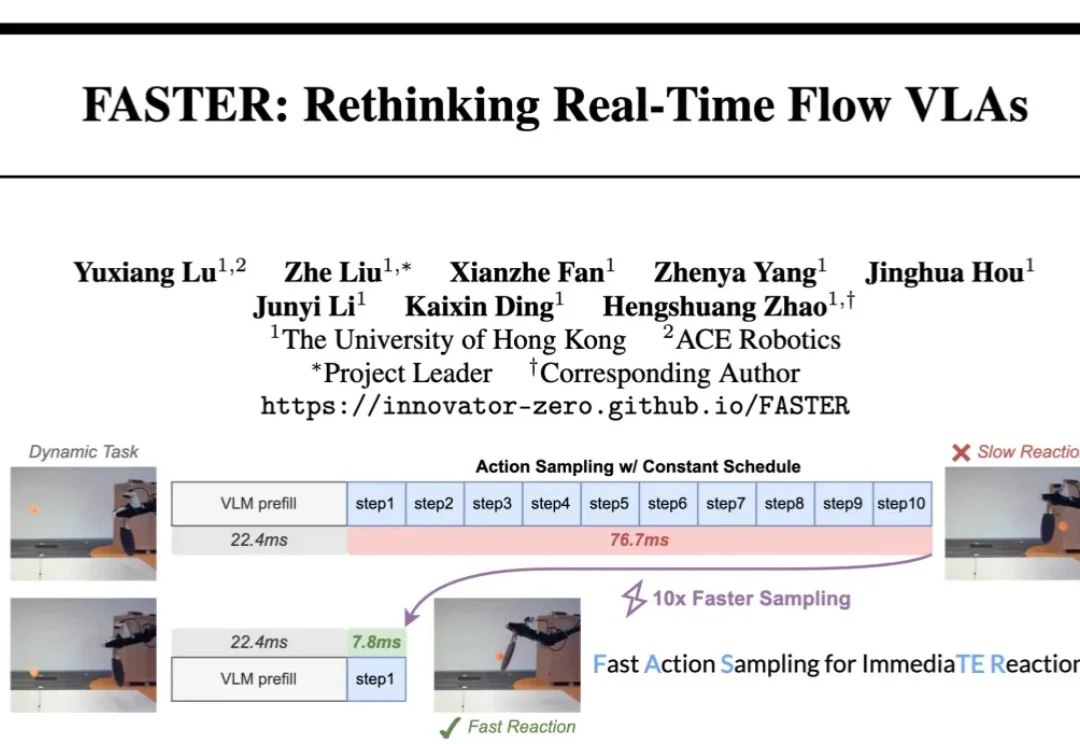

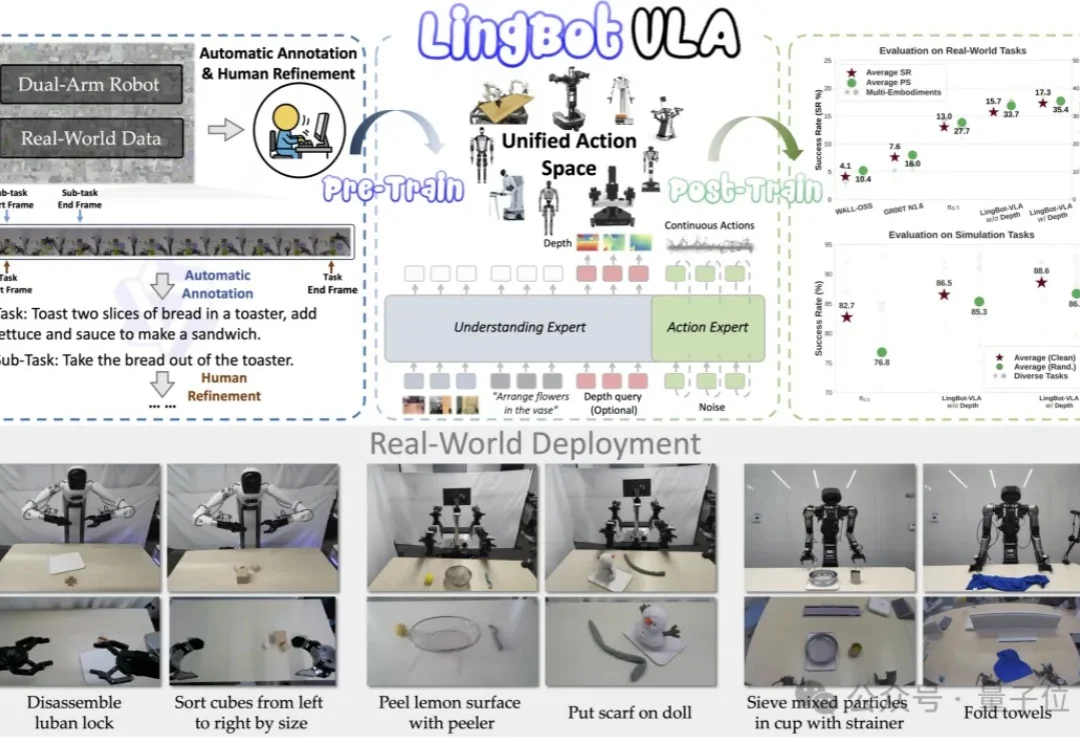

具身智能正以前所未有的速度发展,VLA 模型展现出越来越强的动作和泛化能力。然而,当我们真正把 VLA 模型部署到物理世界时,一个核心挑战浮出水面:实时性。

开普勒机器人前 CEO 胡德波已开启具身智能赛道的第二次创业,新公司名为「索塔无界」。这一次,他选择了一条和开普勒不同的路。索塔无界将在今年夏天展示完整大脑能力,包括世界模型、多模态 VLA 以及 Physica-Claw 机器人操作系统,并在实验室跑通早期商业场景全流程。

2026 年,“世界模型” 正在成为具身智能行业的高频词。越来越多公司开始将自己的技术路线表述为机器人世界模型,试图用可学习的环境模型提升机器人训练效率。

Z Potentials独家获悉,清华系具身智能公司灵御智能宣布完成天使+轮近亿元人民币融资。本轮融资距离上次融资仅有两个月,由福田资本领投,力合创投、金沙江联合资本、复利多、楹辉创投、华仓资本跟投,老股东英诺基金、天鹰资本持续加注。Maple Pledge枫承资本长期出任公司私募股权融资顾问。

就在刚刚,蚂蚁集团旗下具身智能公司灵波科技传出新动作—— 全面开源其具身基座模型LingBot-VLA的真机后训练工具链。