2700GB高质量数据,训出空间智能SOTA,背后秘诀全栈开源

2700GB高质量数据,训出空间智能SOTA,背后秘诀全栈开源什么在限制空间智能落地?

什么在限制空间智能落地?

做深度估计、深度补全的人,大概都有过这样一个瞬间。

“上牌桌,等风来。”

大模型的狂热已然退潮。当我们将目光从参数榜单转向真实的活跃数据,四家头部大厂的底层商业图谱已极度收敛。AI的竞争,早已变成一场基于算力成本与高频场景的残酷算账。

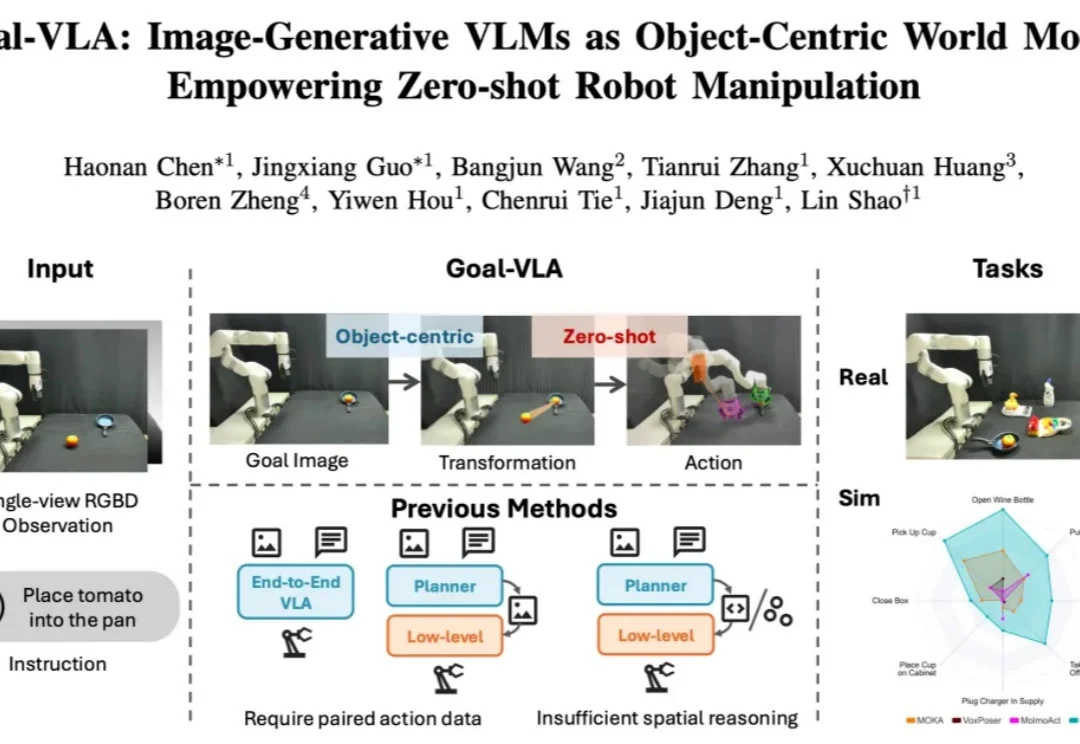

在具身智能领域,机器人操作的泛化能力一直是一个核心挑战。当前,视觉 - 语言 - 动作(VLA)模型主要分为两大范式:端到端模型与分层模型。端到端 VLA 模型(如 RT-2 [1], OpenVLA [2])严重依赖海量的 “指令 - 视觉 - 动作” 成对数据,获取成本极高,导致其在面对新任务或新场景时零样本泛化能力受限。

Karpathy给一支平均年龄25岁的「叛军」站台,红杉和GV连眼都不眨就拍出1.8亿美金。这群人放话:要么把效率干得比人脑高10倍,要么看着AI把地球烧干!

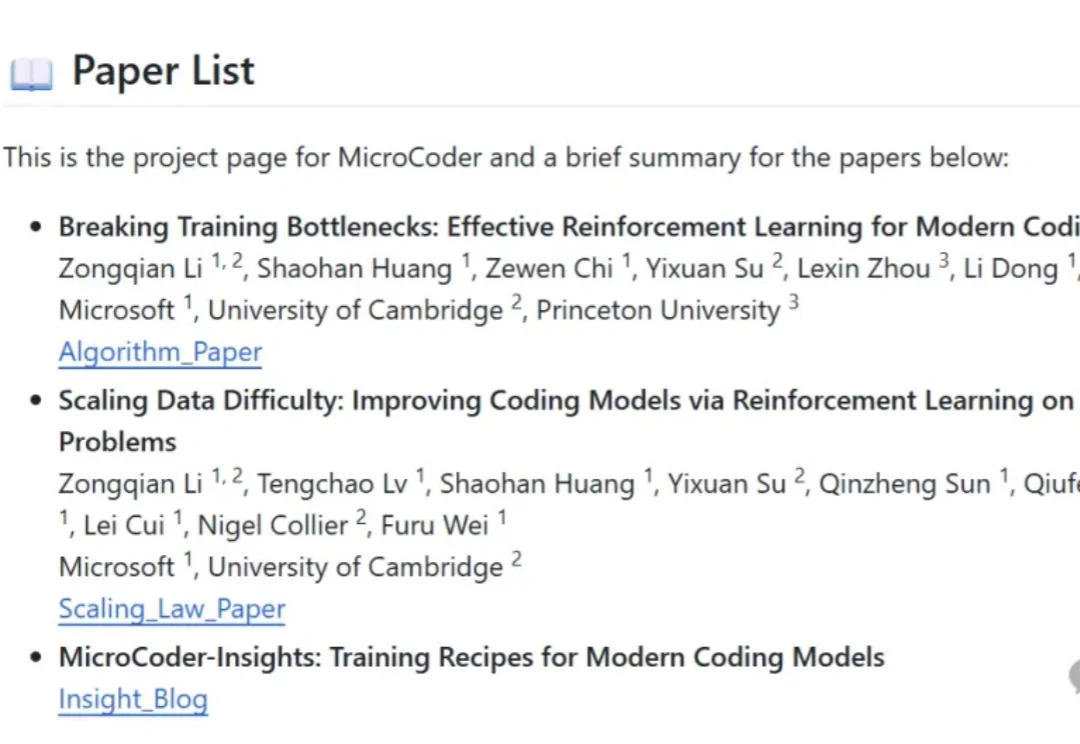

新一代代码模型的训练动态已与旧模型截然不同,主流强化学习方法和数据集在其上几乎“失效”。

就在行业仍为数据瓶颈焦虑时,一家名为深度机智(DeepCybo)的公司悄然浮出水面。投中网独家获悉,作为北京中关村学院与中关村人工智能研究院孵化的首家具身智能企业,它凭借独特的“人类第一视角”技术路线,在短短3周内吸引了超60家投资机构密集对接。

用 Claude Code 写代码的人都熟悉一个场景:Claude 每执行一个命令、每改一个文件,都要你点一次“同意”。Anthropic 的数据显示,用户 93% 的操作都会批准。也就是说,这个“安全审批”环节,绝大多数时候只是一个条件反射。

ICLR'26新研究CPiRi打破时序预测僵局:用冻结底座提取时序特征,轻量模块专注学习通道间真实关系,不靠位置编码「背答案」。测试中通道乱序性能零波动,仅用25%数据即可泛化至全网络,真正实现鲁棒与精准双赢。