独家!腾讯新AI产品“Vedas AI”浮出水面,打造可执行任务的AI助手

独家!腾讯新AI产品“Vedas AI”浮出水面,打造可执行任务的AI助手《读佳》获悉,腾讯近期正在开发一款AI助手产品“Vedas AI”,定位是聪明可靠的AI助手,帮用户做数据分析,写PPT,搭网页,出调研报告,还能自动跑任务。不过该产品还未对外公开使用。 从产品的描述

《读佳》获悉,腾讯近期正在开发一款AI助手产品“Vedas AI”,定位是聪明可靠的AI助手,帮用户做数据分析,写PPT,搭网页,出调研报告,还能自动跑任务。不过该产品还未对外公开使用。 从产品的描述

Anthropic 的 Claude Code 源代码泄漏事件余波未平,另一场事故又接踵而至了。

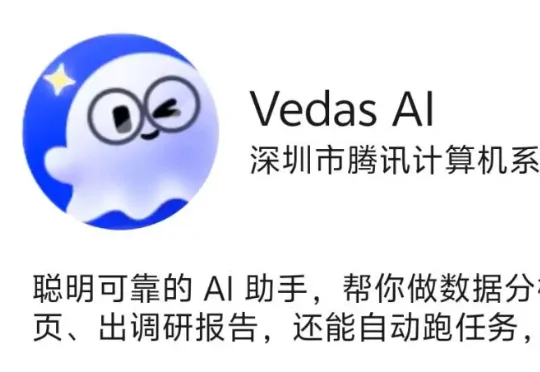

去年讨论Agent落地时,重点往往是Context Engineering。大家都在琢磨怎么放 Few-shot,怎么优化 RAG 检索的文本片段。但随着 Agent 任务复杂度的上升,控制数据流向、工具调度和异常处理的底层脚手架代码,往往比单纯拼接文本对系统性能的影响更大。

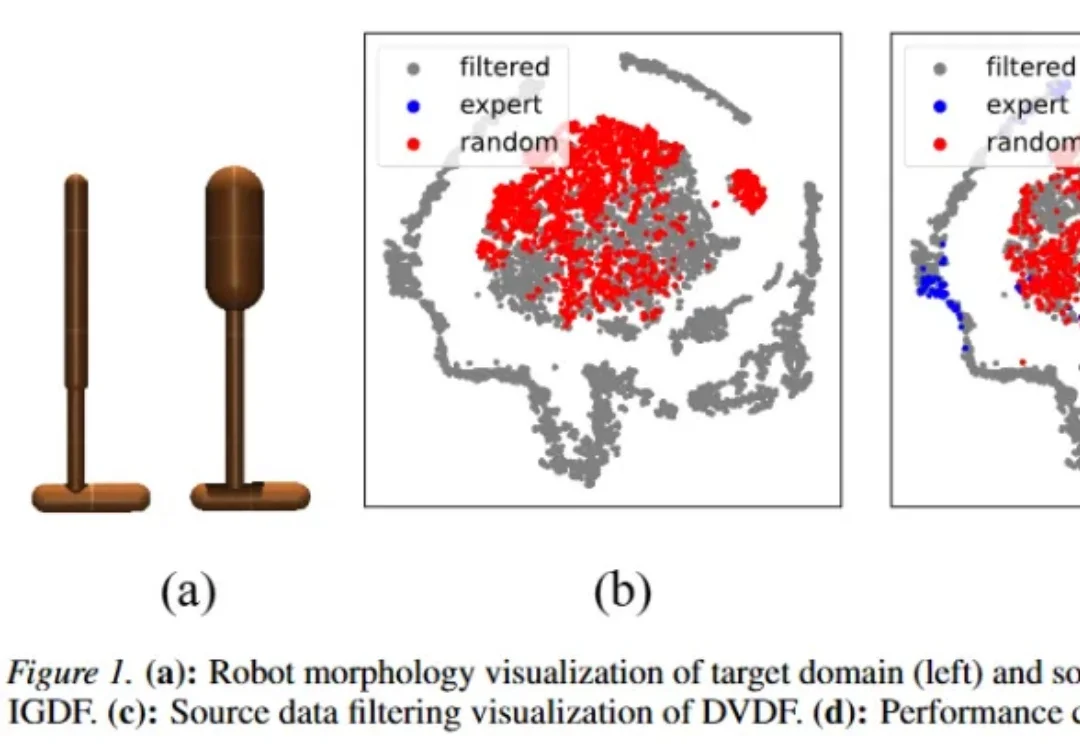

在现实世界中通过强化学习训练智能体,往往需要大量在线试错与环境探索,这不仅成本高昂,还可能带来显著安全风险:机器人可能因试错而损坏,自动驾驶的在线探索可能危及行车安全,而持续采集交互数据本身也代价巨大。

就在这个节骨眼上,我发现了一个非常有意思的东西,科大讯飞在 GitHub 上开源了一个叫 SkillHub 的项目。简单说,SkillHub 就是一个可以私有化部署的 Skill 技能包管理平台,团队可以在自己服务器上搭建,数据完全掌握在自己手上。

相似度超越Seed-TTS、MiniMax-Speech等知名模型。昨晚,美团LongCat团队发布了文本转语音模型LongCat-AudioDiT,并开源1B、3.5B参数量的版本。这一模型的最大特点,是彻底抛弃了梅尔谱等中间表示,直接在波形潜空间进行基于扩散模型的文本转语音。通俗地说,这一模型直接根据声音本身的规律进行生成,“雕刻”出最原始的声音波形,从根源阻断数据转换的级联误差。

3月30日,阿里巴巴内部发布了 Wan2.7-Image 图像生成与编辑统一模型。根据官方公布的数据,在人类偏好盲测评分中,Wan2.7-Image 目前位列国内第一。从放出的评测雷达图来看,无论是文本生图(Text-to-Image)还是综合图像编辑(Image Editing),它的各项指标基本都盖过了市面上主流的几家头部模型。

DigClaw 创始团队意识到,快速变革的AI时代下,利用大模型捕捉并处理这些商业“弱信号”成为可能,而这将彻底重构 B2B 获客的基础设施。2025 年,DigClaw 正式起航,试图用 AI 重构信息基础设施,用商业“弱信号”识别“你在什么阶段、什么业务、什么场景之下需要什么产品”,并转化为 B2B 企业可落地的商业阿尔法。

具身数据层的全球竞赛正在迅速升温。NVIDIA Research在2026年发布EgoScale数据与训练框架,在Ego-centric人类操作视频上训练VLA模型,用 20,854小时带动作标注的第一人称人类视频,观察到数据规模和验证损失之间接近对数线性的scaling law。1X收集人类第一视角及家庭行为数据,通过 Sunday项目采集百万小时级家庭场景视频。

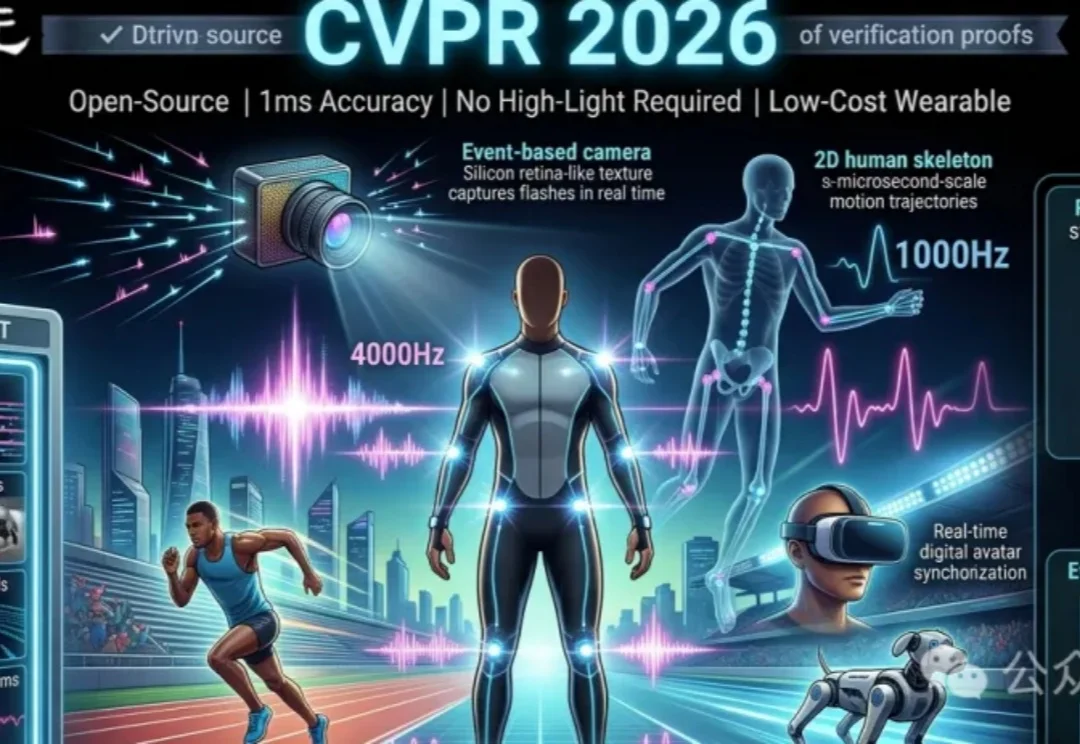

全球首个1毫秒级人体动作捕捉系统FlashCap,通过闪烁LED与事件相机结合,实现1000Hz超高帧率捕捉。无需昂贵设备或强光环境,低成本穿戴服即可精准捕捉极速动作。团队同步开源715万帧的FlashMotion数据集与多模态模型ResPose,显著提升运动分析精度,推动体育、VR与机器人领域迈向高动态智能新阶段。