解析大模型中的Scaling Law

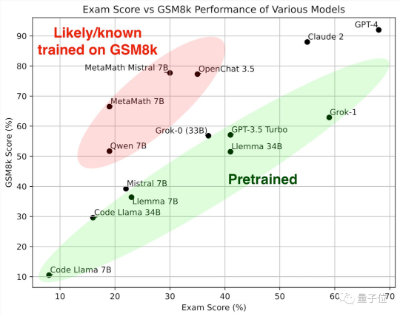

解析大模型中的Scaling Law计划训练一个10B的模型,想知道至少需要多大的数据?收集到了1T的数据,想知道能训练一个多大的模型?老板准备1个月后开发布会,给的资源是100张A100,那应该用多少数据训一个多大模型最终效果最好?

计划训练一个10B的模型,想知道至少需要多大的数据?收集到了1T的数据,想知道能训练一个多大的模型?老板准备1个月后开发布会,给的资源是100张A100,那应该用多少数据训一个多大模型最终效果最好?

大模型正变得越来越“像人”,但事实真是如此吗?现在,一篇发表Nature上的文章,直接否决了这个观点——所有大模型,都不过是在玩角色扮演而已!

RLHF今年虽然爆火,但实打实用到的模型并不多,现在还出现了替代方案,有望从开源界“出圈”;大模型透明度越来越低,透明度最高的是Llama 2,但得分也仅有54;

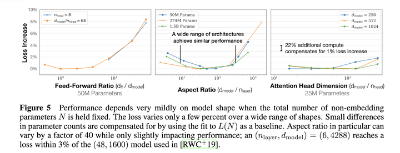

如今很多大模型都声称擅长数学,谁有真才实学?谁是靠背测试题“作弊”的?有人在今年刚刚公布题目的匈牙利全国数学期末考试上做了一把全面测试。很多模型一下子就“现原形”了。

在2023年的科技领域,无论是桌面还是移动处理器,它们都已经开始步入了AI的新纪元。自OpenAI的ChatGPT引发了AI技术的爆发性增长后,AI已经成为了2023年全球科技界的主宰主题。位于科技漩涡中心的处理器市场自然也受到了这股风潮的影响。

11月14日,阿里巴巴智能信息事业群发布全栈自研、千亿级参数的夸克大模型,将应用于通用搜索、医疗健康、教育学习、职场办公等众多场景。夸克App将借助自研大模型全面升级,加速迈向年轻人工作、学习、生活的AI助手。

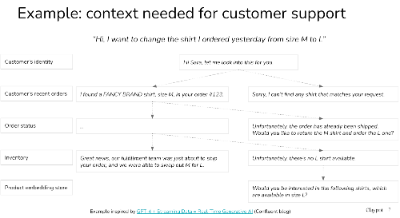

最近,Google DeepMind发布了一段小视频,据说是在向普通人展示大语言模型的工作原理。网友看后纷纷表示:懂得都懂。

大模型赛道已经吸引了大量企业或创业者投入,那么,目前大模型赛道都有哪些主流研究方向和共同挑战?这篇文章里,作者梳理了LLM研究的十大挑战,一起来看看

AI行业的“百模大战”已经打了大半年。从上半年的火热,到下半年的渐冷,胜负难分。GPT成了国内厂商的靶子。几乎每家在发布大模型时,都要把GPT拉出来对比一波,而且他们总能找到一个指标把GPT超越——比如,中文能力。

AGI应该如何发展、最终呈什么样子? 现在,业内第一个标准率先发布: AGI分级框架,来自谷歌DeepMind。